W poprzednim wpisie ustawiłem tezę, która jest osią całej tej mini-serii. Pierwszy AI pisze. Drugi AI czyta. Jeśli używasz ChatGPT, Claude’a, Gemini albo polskich narzędzi typu Contentbot do generowania artykułów na bloga, robisz pracę z pierwszym AI. Ale ta praca trafia potem do drugiego — modelu, który będzie ją cytować, streszczać albo ignorować w odpowiedzi na pytania użytkowników. I drugi AI staje się coraz lepszy w rozpoznawaniu, co jest tekstem generowanym, a co nie.

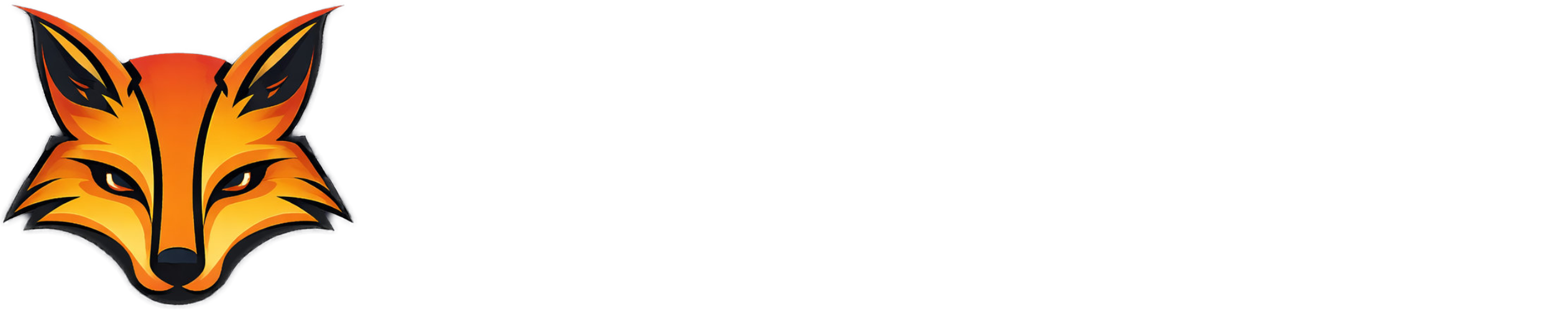

Ten wpis nie odpowiada na pytanie „czy używać AI do generowania artykułów”. To pytanie jest już za nami — każdy, kto pisze w skali, używa, albo wkrótce zacznie. Pytanie, które stawiam, brzmi inaczej: co odróżnia generowanie, które działa, od generowania, które zostawia ślady i zabija ruch. To jest praktyczne pytanie, na które odpowiedź znajduje się w trzech warstwach — narzędzia, technika użycia i obudowa techniczna treści.

Co generatory dziś potrafią

Stan generatorów językowych w kwietniu 2026 jest taki, że techniczna jakość wyniku przestała być głównym ograniczeniem. ChatGPT-5 (o ile jest dostępny — poniżej dokładniej) , Claude Sonnet 4.5, Gemini Pro w wersji 2.5, każde z tych narzędzi potrafi wygenerować artykuł, który po stronie technicznej (gramatyka, składnia, struktura) jest poprawny. Bywa nawet bardzo dobry. Polskie narzędzia, które bazują na tych modelach z dodatkową warstwą interfejsową — Contentbot, polskie integracje Jaspera albo Copy.ai — dają podobną jakość, lokalnie zoptymalizowaną pod polski rynek.

Ale techniczna poprawność nie jest tym samym, co wartość treści. To jest dystinkcja, która w dyskusjach o generatorach często znika. Tekst poprawny gramatycznie może być jednocześnie:

- Generyczny (mówi to, co już mówi tysiąc innych tekstów)

- Pozbawiony lokalnego kontekstu (mógłby być napisany dla dowolnego polskojęzycznego rynku)

- Powierzchowny (porusza temat, ale nie wchodzi w niego)

- Niezweryfikowany (zawiera fakty, które brzmią dobrze, ale nie są prawdziwe)

- Bez głosu (brzmi jak tekst napisany przez nikogo)

Każda z tych pięciu cech jest dziś sygnałem dla drugiego AI, że tekst jest wytworem masowego generatora. I drugi AI coraz częściej potrafi je rozpoznać — nie przez analizę składni, ale przez analizę sygnatury treściowej. Pisałem o pokrewnym temacie w wpisie o filarze drugim agent-readiness, gdzie mowa o tym, że agent ufa danym strukturalnym bardziej niż samej treści. Ten sam mechanizm działa w odwrotną stronę — kiedy treść jest zbyt gładka i zbyt generyczna, brak danych strukturalnych staje się dodatkowym sygnałem niewiarygodności.

Kiedy generowanie zostawia ślady

Trzy konkretne sygnatury, po których drugi AI rozpoznaje masowo generowany tekst.

Pierwsza — strukturalna powtarzalność. Generatory mają preferencje formalne: trójdzielna struktura nagłówków, typowe frazy łącznikowe („w kontekście tego”, „warto zauważyć, że”, „podsumowując, można powiedzieć”), ostatnie zdanie domykające w określony sposób. Jeśli jeden tekst ma takie wzorce, jest to detal. Jeśli wszystkie teksty na stronie mają te same wzorce — staje się to sygnaturą. Drugi AI, który widzi tysiące twoich tekstów, łatwiej rozpozna powtarzalność niż człowiek, który czyta tylko jeden.

Druga — semantyczna powierzchowność. Generatory są dobre w opisaniu tematu, słabsze w jego pogłębieniu. Tekst o tym, „jak prowadzić bloga firmowego”, napisany przez generator, prawdopodobnie wymieni: regularność publikacji, znajomość grupy docelowej, jakość treści, optymalizację pod SEO. Wszystko prawda, wszystko bezużyteczne — bo każdy inny generator napisze to samo. Drugi AI, mając do wyboru cytowanie tego artykułu albo artykułu, w którym autor opisuje konkretny przypadek z własnej praktyki, wybierze ten drugi. Nie dlatego, że pierwszy jest „gorszy”, tylko dlatego, że drugi coś dodaje.

Trzecia — fakty bez źródeł. Generatory potrafią powiedzieć „badania pokazują, że 78% konsumentów…” albo „raport McKinsey z 2024 roku wskazuje”. Czasem to jest prawda. Często to jest halucynacja — model wygenerował wiarygodnie brzmiące dane, które nie istnieją. Drugi AI, który czyta twoją stronę i sprawdza ten cytat w swoich własnych źródłach, ma trzy możliwe reakcje. Jeśli fakt jest prawdziwy — zacytuje. Jeśli nie istnieje — zignoruje. Jeśli istnieje, ale w innej formie — zacytuje twoją wersję jako niewiarygodną. Trzeci scenariusz jest najgorszy, bo aktywnie szkodzi twojej reputacji jako źródła.

Te trzy sygnatury razem tworzą obraz tekstu, który technicznie jest w porządku, ale funkcjonalnie przestaje pełnić swoją rolę. Człowiek może go przeczytać i nie zauważyć problemu. Drugi AI go zauważy i odpowiednio potraktuje.

Jak generować, żeby tekst działał w obu warstwach

Trzy techniki, które praktycznie odróżniają generowanie produktywne od generowania, które zostawia ślady.

Pierwsza — generuj szkielet, dopisuj treść. Generator nadaje się świetnie do wygenerowania struktury artykułu, listy podpunktów, propozycji tytułów. Sam jednak rzadko nadaje się do napisania tekstu finalnego. Przepływ pracy, który działa: generator dostaje brief, wypluwa szkielet, ty wypełniasz konkretami z własnej praktyki. To jest dwukrotnie szybsze niż pisanie od zera, i nie zostawia śladów masowości — bo treść w środku jest twoja.

Druga — używaj generatora jako redaktora, nie autora. Drugi przepływ: piszesz tekst sam (albo z minimalnym wkładem AI), potem dajesz go generatorowi do polerki. To rozwija się w trzeciej części tej mini-serii (wpis o polerowaniu) — ale podstawowa zasada brzmi: AI lepiej naprawia nieporadny tekst, niż tworzy świetny od zera. Jeśli wykorzystasz tę asymetrię, dostajesz tekst, w którym charakter autora jest zachowany, a problemy techniczne są rozwiązane.

Trzecia — weryfikuj fakty, zawsze. Każdy fakt liczbowy w tekście wygenerowanym przez AI wymaga sprawdzenia w źródle pierwotnym. Nawet jeśli model brzmi pewnie. Nawet jeśli „raport McKinsey” wygląda autentycznie. Ta jedna zasada eliminuje większość halucynacji — i jest jednocześnie tym, co najbardziej różni profesjonalne użycie generatora od amatorskiego.

Box: narzędzia do generowania artykułów — przegląd w 2026

ChatGPT (OpenAI) — najpopularniejszy globalnie. W wersji Plus dostępny GPT-5 (limity zależnie od abonamentu). Mocna w językach poza angielskim, w tym po polsku.

Claude (Anthropic) — model wybierany często przez profesjonalnych redaktorów ze względu na charakter wynikowych tekstów (mniej generyczne niż GPT). Polski wsparty dobrze, choć z mniejszym ekosystemem narzędzi pochodnych niż OpenAI.

Gemini (Google) — od wersji 2.5 Pro konkurencyjna jakość. W Workspace dostępna jako natywny asystent Google Docs. Polski wsparty.

Jasper — komercyjne narzędzie nadbudowane nad GPT i innymi modelami, z gotowymi szablonami dla content marketingu. Mniej elastyczne, więcej automatyzacji.

Copy.ai — analogicznie do Jaspera, z naciskiem na krótkie formy (posty, opisy produktów, meta-opisy).

Contentbot — polskie narzędzie, lokalna alternatywa dla Jaspera. Interfejs po polsku, integracje z polskimi narzędziami SEO.

Wordnik — kolejne polskie narzędzie, bardziej zorientowane na blogerów niż profesjonalne redakcje.

Wtyczki WordPress — AI Engine, GetGenie, Bertha AI — pozwalają generować bezpośrednio w edytorze WordPressa, bez przenoszenia treści między narzędziami. Każda ma własny model w tle.

Wybór narzędzia nie jest najważniejszą decyzją. Większe znaczenie ma sposób, w jaki narzędzie jest używane — i obudowa techniczna, którą tekstowi nadasz po jego napisaniu.

Obudowa techniczna — gdzie generowanie spotyka agent-readiness

Tekst napisany z pomocą AI, opublikowany bez żadnej obudowy technicznej, jest dla drugiego AI tylko ciągiem słów. Tekst napisany z pomocą AI, opublikowany z pełnym JSON-LD typu Article, wskazaniem autora jako Person z URL-em, datami publikacji i modyfikacji w formacie ISO 8601, hreflangiem, czystą semantyką nagłówków — jest dla drugiego AI tym samym ciągiem słów plus warstwą sygnałów, które mówią „to jest treść autorytatywna”.

Ta druga sytuacja jest paradoksalnie korzystniejsza dla treści generowanej niż dla autorskiej. Bo treść autorska często ma za sobą inne sygnały — autora, którego model już rozpoznaje, domenę, którą cytował wcześniej, historię publikacji. Treść generowana zaczyna od zera. I właśnie dlatego dane strukturalne są dla niej kompensacją — sygnałem technicznym, który rekompensuje brak sygnałów reputacyjnych.

Pisałem o tym konkretnie w wpisie o JSON-LD w WordPressie, Divi i WooCommerce. Tu sprowadzam to do trzech praktycznych zasad dla treści generowanej:

- JSON-LD typu BlogPosting albo Article jest obowiązkowy. Nie opcjonalny. Bez niego treść generowana jest dla agenta nieodróżnialna od treści napisanej przez nikogo.

- Author musi być konkretną osobą (typ Person), nie organizacją. Nawet jeśli treść była generowana z pomocą AI — autorem jest człowiek, który ją zredagował i opublikował. Ten człowiek musi mieć profil na stronie, własny URL, sensowny opis.

- DateModified musi być aktualizowana po każdej znaczącej zmianie. Treść generowana często wymaga aktualizacji częściej niż autorska — bo halucynacje wychodzą w czasie. Brak aktualizacji daty jest sygnałem, że treść jest porzucona.

W kontekście całej ramy agent-readiness, te trzy zasady są częścią filaru drugiego (dane strukturalne). Bez nich praca z pierwszym AI przy generowaniu nie ma większego sensu — bo drugi AI nie odróżni twojego tekstu od dziesiątek tysięcy innych podobnych.

Co z tego wynika praktycznie

Cztery rekomendacje, które warto zachować w głowie, jeśli używasz AI do generowania artykułów na WordPressowym blogu.

Po pierwsze — generuj świadomie, nie pasem produkcyjnym. Każdy artykuł powinien przejść przez ręce człowieka, który dodaje konkrety z własnej praktyki, weryfikuje fakty, dopracowuje głos. Pasmo produkcyjne (generuj-publikuj-dalej) prowadzi do treści, którą drugi AI rozpoznaje jako masową — i przestaje cytować.

Po drugie — inwestuj w obudowę techniczną. Każdy generowany tekst opublikowany z pełnym JSON-LD, świadomym hreflangiem, profilem autora i aktualnymi datami modyfikacji ma większą szansę być dostrzeżony przez drugi AI niż genialny tekst bez tych warstw. To rozróżnienie zaciera tradycyjną hierarchię „świetna treść > techniczna obudowa”.

Po trzecie — weryfikuj fakty, zawsze. Halucynacje są jedynym aspektem generowania, w którym dziś nie ma technologicznego rozwiązania. Tylko ludzka weryfikacja. To brzmi jak żmudne, ale jest jednocześnie tym, co najbardziej odróżnia treść profesjonalną od amatorskiej.

Po czwarte — pamiętaj, że ślad zostaje. Tekst opublikowany dziś w internecie zostaje. Jeśli drugi AI raz uzna twoją stronę za generycznie generowaną, ten sygnał będzie się ciągnął przez kolejne treści, które publikujesz. To nie jest moment, w którym warto oszczędzać na jakości — bo każdy oszczędny tekst psuje reputację domeny.

Co dalej w mini-serii

Następny wpis (#3) dotyczy polerowania — innego użycia AI w pracy z treścią, gdzie pułapki są mniej oczywiste, ale podobnie konkretne. Tam mowa będzie o tym, kiedy AI ratuje tekst, a kiedy go niszczy — i dlaczego gładkość bywa wadą.