Pięć poprzednich wpisów tej serii dotyczyło pięciu różnych rzeczy. Pay-per-crawl jako monetyzacja. llms.txt jako standard. WebMCP jako produkcyjna usługa. Instant Checkout jako kanał sprzedaży. Tożsamość agenta jako rozwiązany problem. Każdy z tych tematów ma własną dynamikę, własną historię, własne źródła hype’u. Ale wszystkie pięć łączy coś, co warto nazwać wprost — struktura branżowej narracji, która ujmuje funkcje w preview jako produkty gotowe do sprzedaży.

Ten wpis zamyka serię, ale nie podsumowuje jej w klasyczny sposób. Zamiast streszczenia pięciu wcześniejszych wpisów — destylacja zasad. Pięć sygnałów, które warto rozpoznawać w branżowych narracjach o agentach AI, agentic commerce, agent-readiness, niezależnie od tego, którego konkretnie tematu dotyczą. Bo seria pokazała, że wzorzec się powtarza. Pay-per-crawl, llms.txt, WebMCP, Instant Checkout, tożsamość agenta — to są pięć przykładów tego samego mechanizmu. Znajomość mechanizmu jest cenniejsza niż znajomość pięciu konkretnych przypadków. Bo następna fala będzie miała pięć innych nazw, ale ten sam kształt.

Test, którego ten wpis nie chce oblać — sygnały są tym, co i autor tej serii mógłby zaniedbać. Pisząc o agencie AI, o standardach, o protokołach, łatwo wpaść w taki sam mechanizm. Uniknięcie tego nie polega na braku entuzjazmu wobec technologii. Polega na sprawdzeniu, czy entuzjazm jest oparty na statusie istnieje czy działa produkcyjnie. To są dwie różne rzeczy.

Sygnał pierwszy — „standard” bez ratyfikacji

Najczęstszy mechanizm hype’u opiera się na słownictwie. Słowo „standard” w narracji branżowej zaczyna oznaczać dwie zupełnie różne rzeczy. Albo coś, co przeszło proces ratyfikacji w organizacji typu IETF, W3C, Ecma International. Albo coś, co ktoś nazwał standardem, bo wymyślił specyfikację i wrzucił ją na stronę.

Te dwie rzeczy są kategorialnie różne. Standard ratyfikowany ma proces wersjonowania, listę formalnych implementacji, organizacyjne zobowiązania od operatorów oprogramowania. Propozycja, którą ktoś nazwał standardem, ma stronę internetową i autora.

W serii ten sygnał pojawił się najmocniej przy llms.txt. Propozycja Jeremy’ego Howarda z 2024 roku jest w polskich publikacjach branżowych z 2026 określana jako „standard agentyczny”, „nowy schema.org dla AI”, „obowiązkowy element SEO”. Realny status — niesratyfikowana propozycja, nierówna adopcja u głównych dostawców (Google publicznie nie wspiera), brak twardych dowodów skuteczności.

Test rozpoznawczy. Kiedy w branżowej publikacji pojawia się słowo „standard”, warto sprawdzić, w której kategorii. Trzy konkretne pytania:

- W jakiej organizacji standardyzującej jest ratyfikowany? Brak odpowiedzi to sygnał, że to propozycja, nie standard.

- Jaka jest data ratyfikacji? Brak daty to sygnał, że proces albo nie nastąpił, albo nie istnieje.

- Jaka jest lista formalnych implementacji? Brak listy to sygnał, że zobowiązania nie istnieją.

Propozycja może być wartościowa. Może w przyszłości stać się standardem. Ale nazywanie jej dziś standardem to skracanie kategorii do efektu sprzedażowego.

Sygnał drugi — preview sprzedawane jako produkcja

Drugi mechanizm dotyczy etapu rozwoju funkcji. W angielskim świecie technologii istnieje wyraźna nomenklatura: experimental, alpha, beta, preview, general availability (GA), stable. Każdy z tych etapów ma własne zobowiązania — co do stabilności API, kompatybilności wstecznej, gotowości na produkcyjne wdrożenia.

W polskich branżowych narracjach te kategorie często się zlewają. Funkcja w preview jest opisywana tak, jakby była już GA. Eksperymentalne API jest sprzedawane jako gotowy interfejs. Klient płaci za wdrożenie, nie wiedząc, że specyfikacja, której wdrożenie kupuje, może się jeszcze zmienić w sposób niekompatybilny.

W serii ten sygnał pojawił się przy WebMCP. Funkcja udostępniona przez Chrome w preview w lutym 2026, dostępna w wybranych kanałach Canary i Dev, wymagająca flagi eksperymentalnej, ze specyfikacją podlegającą zmianom. W tym samym czasie polski rynek zaczął obejmować ten przypadek ofertą agencyjnych „wdrożeń WebMCP” jako gotowych pakietów sprzedażowych.

Test rozpoznawczy. Kiedy oferta dotyczy konkretnej funkcji albo standardu, warto sprawdzić jej etap rozwoju:

- Czy jest dostępna w stable, czy tylko w preview/canary/eksperymentalnym kanale? Tylko stable jest produkcyjnie wiarygodne.

- Czy specyfikacja jest finalna, czy może się zmienić? Niefinalna specyfikacja oznacza, że dzisiejsze wdrożenie może wymagać przeróbki za miesiąc.

- Czy są publiczne case studies wdrożeń produkcyjnych? Brak case studies to sygnał, że eksperyment nie wszedł jeszcze w fazę produktową.

Eksperymentowanie z funkcjami w preview jest rozsądne. Sprzedawanie tych eksperymentów jako produkcyjnej usługi — nie jest.

Sygnał trzeci — narracja konkurencyjna bez bazy

Trzeci mechanizm operuje na poziomie psychologii czytelnika. Narracja przyjmuje formę: „twoja konkurencja już to wdraża”, „kto pierwszy, ten lepszy”, „za rok będzie za późno”. Cel jest jeden — wywołać poczucie pilności, które przyspieszy decyzję zakupową, zanim klient zdąży zweryfikować, czy oferta odpowiada rzeczywistości.

Problem polega na tym, że taka narracja zazwyczaj nie podaje kto konkretnie z konkurencji już to wdrożył. Mówi „polskie firmy są w tyle”, ale nie wymienia, które polskie firmy są na czele. Mówi „rynek już idzie w tym kierunku”, ale nie pokazuje danych o adopcji. To nie jest analiza konkurencji — to jest retoryka pilności.

W serii ten sygnał pojawił się najmocniej przy pay-per-crawl. Polski internet 2025-2026 referuje to rozwiązanie jako kierunek monetyzacji ruchu agentowego, mówiąc że „wydawcy odzyskują głos”, że „nowa era mediów”, że „mikropłatności wreszcie znajdują zastosowanie”. W tym samym czasie liczba polskich stron faktycznie zarabiających na pay-per-crawl jest bliska zeru, a operatorzy dużych modeli AI nie zintegrowali się z systemem płatności w skali umożliwiającej ekonomiczne domknięcie.

Test rozpoznawczy. Kiedy narracja używa argumentu „konkurencja już to ma”, warto zadać trzy pytania:

- Kto konkretnie? Brak konkretnych firm to sygnał, że argument jest retoryczny.

- Jakie są ich publicznie dostępne wyniki? Brak case studies to sygnał, że konkurencja może być bardziej deklaratywna niż realna.

- Co dokładnie wdrożyli — produkt czy eksperyment? Tu często okazuje się, że wdrożenie istnieje, ale w fazie testów R&D, a nie jako linia w bilansie.

Pilność jest narzędziem sprzedaży. Realne ryzyko spóźnienia wymaga konkretnych dowodów, nie ogólnikowych haseł.

Sygnał czwarty — fakty bez aktualizacji

Czwarty mechanizm jest może najbardziej charakterystyczny dla polskiego rynku. Branżowe portale często przepisują anglojęzyczne newsy z opóźnieniem kilku dni do kilku tygodni. Ale bardzo rzadko aktualizują swoje wcześniejsze publikacje, kiedy fakty się zmieniają. Tekst sprzed sześciu miesięcy o nowej technologii pozostaje w sieci dokładnie taki, jaki był w dniu publikacji — nawet jeśli technologia od tego czasu została wycofana, zmieniona, zastąpiona.

W serii ten sygnał był osią całego wpisu czwartego — o Instant Checkout i ACP. Październik 2025 — OpenAI ogłasza Instant Checkout. Polski internet pokrywa to z entuzjazmem, opisując nową erę handlu. Marzec 2026 — OpenAI wycofuje Instant Checkout z domyślnego modelu, ACP zostaje zredukowane do warstwy discovery. Polski internet w znacznej mierze nie aktualizuje publikacji z 2025. Wpisy o tym, „jak twój sklep ma się przygotować na Instant Checkout”, wciąż wiszą bez ostrzeżenia, że ich tezy są nieaktualne.

Test rozpoznawczy. Kiedy czytasz publikację o konkretnej technologii albo trendzie, sprawdź:

- Jaka jest data publikacji? Wpis sprzed ponad sześciu miesięcy o szybko ewoluującym temacie jest podejrzanej świeżości.

- Czy autor dodał aktualizacje, jeśli fakty się zmieniły? Brak notatek aktualizacyjnych to sygnał, że wpis żyje w trybie publish-and-forget.

- Czy informacje są spójne z aktualnymi komunikatami operatorów? Sprzeczność z najświeższymi oficjalnymi stanowiskami to sygnał, że publikacja pochodzi z innej epoki.

Ten sygnał jest najtrudniejszy, bo wymaga od czytelnika własnej weryfikacji. Ale jest też najbardziej diagnostyczny — bo dotyka rzetelności źródła, nie tylko jednego konkretnego twierdzenia.

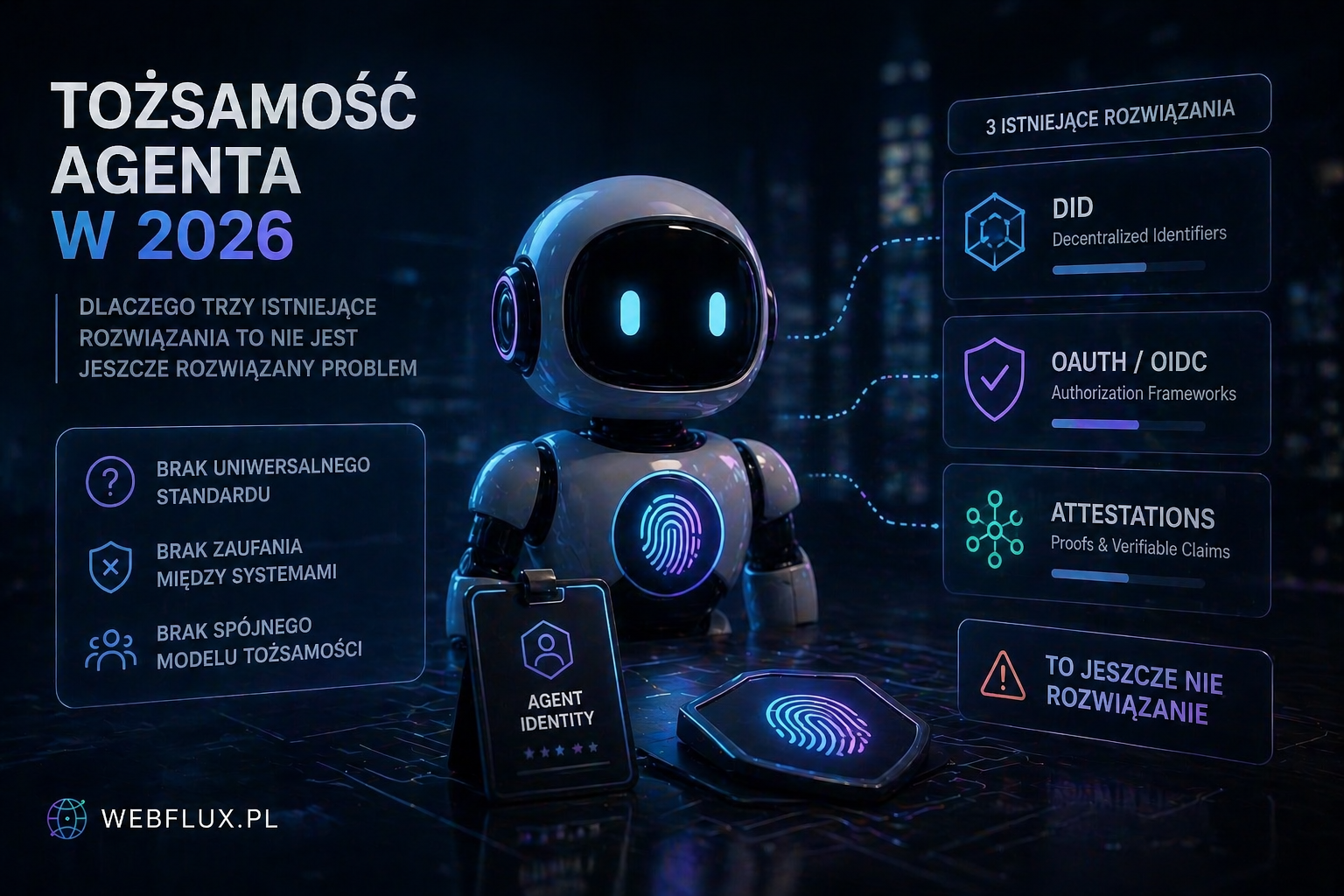

Sygnał piąty — klocki zamiast układanki

Piąty mechanizm jest najbardziej subtelny. Polega na łączeniu kilku rzeczywiście istniejących elementów w narrację, która sugeruje istnienie czegoś, czego suma tych elementów nie tworzy.

Przykład klasyczny — narracja o tożsamości agenta. HTTP Message Signatures istnieje jako standard IETF. AP2 istnieje jako opublikowana propozycja Google’a. Moltbook istnieje jako platforma rejestru tożsamości agentów. Wszystkie trzy są faktami. Każdy z osobna coś robi w warstwie tożsamości agenta.

Ale narracja, która łączy je w zdanie „mamy gotową warstwę tożsamości agenta”, pomija to, że suma tych trzech elementów nie tworzy ekosystemu. Standard kryptograficzny bez infrastruktury zaufania. Protokół płatności w fazie wczesnych testów. Jeden rejestr należący do jednego dostawcy. To są trzy klocki w trzech różnych pudełkach. Aby powstała układanka, musi się zdarzyć coś więcej — masowa adopcja jednego z elementów, harmonizacja standardów, organizacja branżowa typu CA/Browser Forum dla agentów.

Test rozpoznawczy. Kiedy narracja używa kilku konkretnych nazw (RFC, protokół, platforma) jako dowodu na istnienie kompletnego rozwiązania, warto sprawdzić:

- Czy te elementy są ze sobą formalnie zintegrowane? Brak integracji oznacza, że są klockami, nie układanką.

- Czy któryś z elementów ma masową adopcję? Bez adopcji standard pozostaje propozycją na papierze.

- Czy istnieje organizacja koordynująca, która harmonizuje różne elementy? Brak takiej organizacji oznacza, że ekosystem jest fragmentaryczny.

Klocki są wartościowe — bo pokazują, że ktoś pracuje nad rozwiązaniem. Ale nazywanie ich rozwiązaniem to kategorialne nadużycie.

Co z tego wynika praktycznie

Pięć sygnałów razem tworzy listę kontrolną, którą warto mieć w głowie, kiedy czytasz publikacje o agentic web, agentic commerce, agent-readiness, jakimkolwiek nowym standardzie, protokole, platformie. Nie chodzi o to, żeby odrzucać każdą narrację, która któryś z tych sygnałów uruchamia. Chodzi o to, żeby wiedzieć, co czytasz.

Funkcja w preview jest funkcją w preview — może być fascynująca, może być warta eksperymentowania, ale nie jest produkcyjną usługą.

Propozycja jest propozycją — może być świetnym pomysłem, może w przyszłości stać się standardem, ale dziś nie jest standardem.

Konkurencja, której nie wymieniono z nazwy, jest konkurencją retoryczną — może być realna, ale wymaga dowodów.

Wpis sprzed pół roku jest wpisem sprzed pół roku — może być nadal trafny, może być nieaktualny, weryfikacja wymaga sprawdzenia komunikatów źródłowych.

Klocki są klockami — mogą się ułożyć w układankę, ale dziś leżą osobno.

Te pięć rozróżnień nie zatrzymuje rozwoju agentic web. Wręcz przeciwnie — pomaga wybierać, w co warto inwestować dzisiaj, a co warto obserwować na przyszłość. Bo agentic web jako kierunek rzeczywiście się rozwija. Pytanie tylko, w którym miejscu na tej osi rozwojowej jesteśmy w konkretnym przypadku — i czy decyzje biznesowe, które podejmujemy, odpowiadają temu konkretnemu miejscu, czy raczej projekcji o dwa lata do przodu.

Mapa serii

Pięć wpisów, które destylują się w pięć powyższych zasad — pogrupowane przez sygnał, który najsilniej pokazują:

Sygnał drugi (preview jako produkcja) — wpis 3: WebMCP w 2026 — dlaczego sprzedawanie wdrożeń standardu w preview jest sprzedawaniem przyszłości jako teraźniejszości

Sygnał pierwszy (standard bez ratyfikacji) — wpis 2: llms.txt w 2026 — dlaczego standard, którego nie ma, jest reklamowany jako must-have

Sygnał trzeci (narracja konkurencyjna bez bazy) — wpis 1: Pay-per-crawl w 2026 — dlaczego mikropłatności od agentów to jeszcze nie jest twoja monetyzacja

Sygnał czwarty (fakty bez aktualizacji) — wpis 4: ACP w 2026 — co OpenAI wycofało w marcu i dlaczego polski internet jeszcze tego nie zauważył

Sygnał piąty (klocki zamiast układanki) — wpis 5: Tożsamość agenta w 2026 — dlaczego trzy istniejące rozwiązania to nie jest jeszcze rozwiązany problem

Każdy wpis stoi samodzielnie, można go przeczytać niezależnie od reszty. Razem tworzą obraz, który nie jest w żadnym z osobna — systematyczny mechanizm branżowej narracji, który warto rozpoznawać niezależnie od tego, jakiej technologii akurat dotyczy.

Ta seria nie kończy obserwacji agentic web na WebFluxie. Ta seria kończy etap krytyczny. Następne wpisy wracają do trybu pozytywnego — co warto wdrażać, jak to robić, gdzie szukać konkretnych wskazówek. Seria Agent-ready jako rama sześciu filarów. Hub UCP jako pogłębienie agentic commerce. Słownik Agentic Web jako rosnące zaplecze pojęciowe. Krytyka i konstrukcja idą w parze — bo bez krytyki konstrukcja staje się hype’em, a bez konstrukcji krytyka staje się marudzeniem.

Tę równowagę warto utrzymać. Również wobec tej serii — kiedy za rok któraś z opisanych tu „rzeczy, których nie wdrożycie” stanie się rzeczą, którą warto wdrożyć, ten wpis zostanie zaktualizowany. Nie usunięty. Zaktualizowany. Bo to jest sygnał czwarty w działaniu.