Przez ostatnie trzy lata generatory obrazów AI przeszły drogę, której branża fotograficzna i ilustracyjna nie pamięta od narodzin Photoshopa. Midjourney v3 z 2022 roku robił obrazy, na które patrzyło się z fascynacją i równocześnie z pewnym dystansem — fotorealistycznie, ale z charakterystycznymi błędami w dłoniach, oczach, tłach. Midjourney v7 z 2026 roku robi obrazy, których przeciętny czytelnik nie odróżni od fotografii zrobionej aparatem. To samo dotyczy DALL-E 4, Flux 2 czy Stable Diffusion 4. Bariera techniczna upadła.

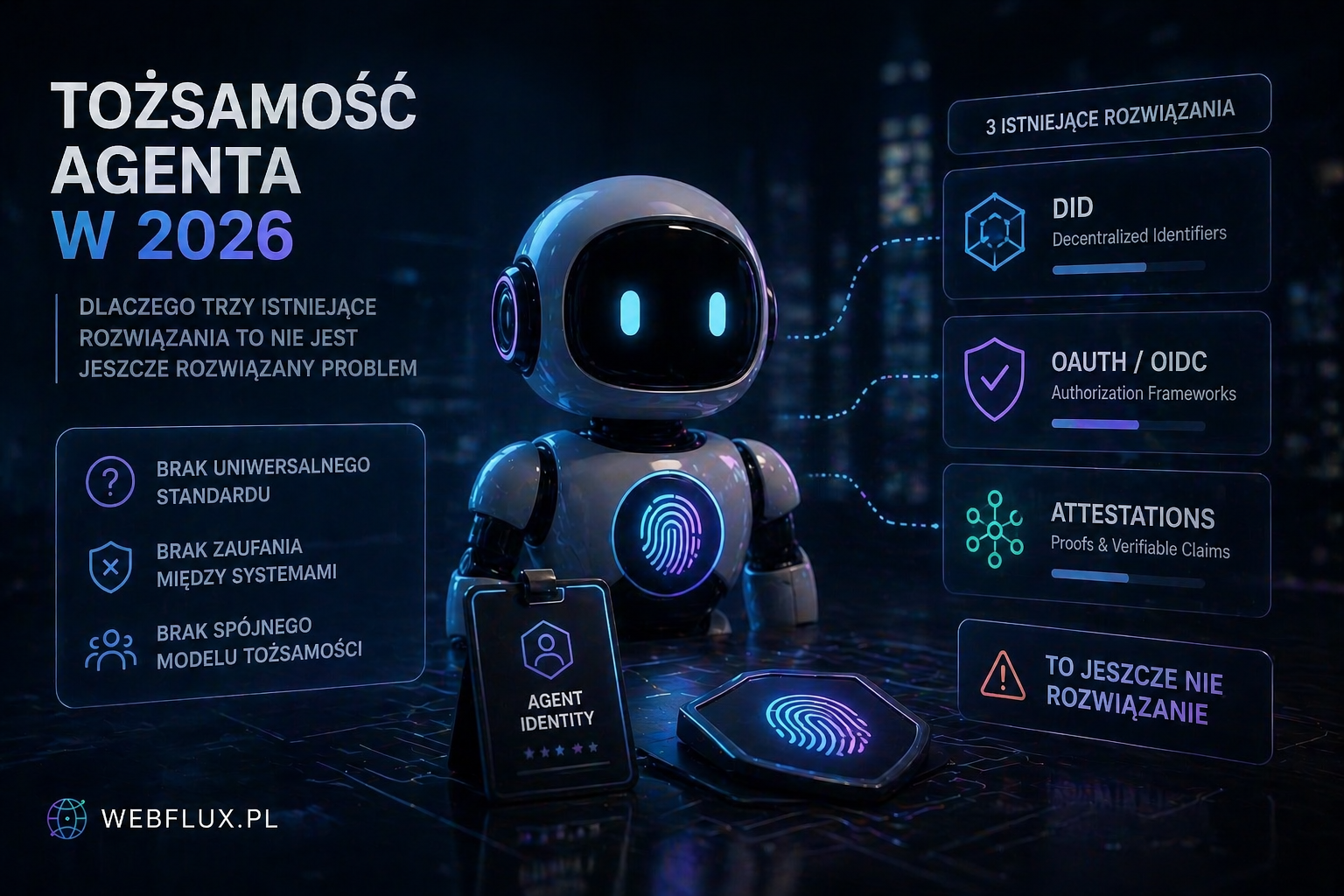

I właśnie dlatego zaczyna się drugi problem. Bo kiedy wszyscy mogą wygenerować dobry obraz w trzy sekundy, dobreobrazy stają się nudne. Nie technicznie — kompozycyjnie. Polski blog branżowy w 2026 roku ma podobne okładki do tysiąca innych: laptopy z neonowymi obwodami, robot piszący na klawiaturze, niebiesko-fioletowe tła z kropkami sieci. Każdy obraz osobno wygląda dobrze. Wszystkie razem brzmią jak chór generycznych ilustracji o AI.

Ten wpis dotyczy piątego z sześciu obszarów w mini-serii o AI do treści. Generowanie obrazów. Konkretnie — kiedy obraz wygenerowany przez AI dodaje wartość do wpisu, a kiedy go obniża. I jak alt-teksty, opisy, watermarking i prawa autorskie wpisują się w warstwę agent-readiness, o której pisałem wcześniej.

Co generatory obrazów potrafią dziś

Cztery główne narzędzia warto rozróżniać, bo każde działa inaczej i każde nadaje się do innego scenariusza.

Box: narzędzia do generowania obrazów AI w 2026

Midjourney — wciąż wzorzec dla obrazów stylizowanych, kompozycyjnie złożonych, z mocnym charakterem wizualnym. Najmocniejszy w generowaniu okładek artykułów i grafik koncepcyjnych. Dostęp przez Discord albo dedykowany interfejs webowy.

DALL-E (OpenAI) — zintegrowany z ChatGPT, łatwiejszy w użyciu, ale generujący obrazy o mniej charakterystycznym stylu niż Midjourney. Dobry do szybkich ilustracji, słabszy do okładek wymagających uwagi.

Flux (Black Forest Labs) — model open-source o jakości porównywalnej z Midjourney, dostępny przez API i lokalne wdrożenia. Mocny w fotorealizmie, słabszy w stylach artystycznych.

Stable Diffusion — model open-source z największą społecznością i ekosystemem narzędzi pochodnych. Wymaga większej wiedzy technicznej, ale daje najwięcej kontroli — własne checkpointy, LoRA, ControlNet.

Adobe Firefly — komercyjne narzędzie zintegrowane z Photoshopem i resztą ekosystemu Adobe. Mocna karta to licencjonowanie obrazów treningowych, co redukuje ryzyko prawne.

Wtyczki WordPress — AI Engine, GetGenie i inne pozwalają generować obrazy bezpośrednio w edytorze. Każda korzysta z jednego z powyższych modeli przez API.

iFOX.pl – nasze narzędzia, których bazę rozbudowujemy.

Wybór narzędzia decyduje o jednym aspekcie — charakterze wizualnym obrazu. Ale nie decyduje o tym, co czyni obraz wartościowym dla wpisu. To jest kwestia użycia, nie wyboru.

Trzy pułapki, w które wpada większość polskich blogów

Pierwsza — generowanie domyślne. Pisząc wpis o WordPressie, blogger wpisuje do generatora „WordPress logo” albo „WordPress dashboard” i bierze pierwszy obraz, który dostaje. Efekt: obraz technicznie poprawny, ale identyczny w idei do dziesiątek innych obrazów na podobne tematy. Generator robi to, co statystycznie najbardziej prawdopodobne — czyli to, co już ktoś przed tobą zrobił.

Druga — stylistyczna jednolitość. Bloger znajduje styl, który mu się podoba (powiedzmy „futurystyczny, niebiesko-fioletowy, neonowy”), i używa go do wszystkich wpisów. Po dwudziestu wpisach jego blog wygląda jak prezentacja firmy technologicznej z 2017 roku — wszystko świeci, wszystko unosi się w powietrzu, wszystko jest gradientem. Czytelnik trafiający na taki blog rozpoznaje go w sekundę. Niestety nie jako charakterystyczny, tylko jako kolejny taki sam.

Trzecia — brak związku z tekstem. Obraz przedstawia robota piszącego na klawiaturze. Tekst dotyczy regulacji AI Act. Połączenie istnieje formalnie (AI), ale obraz nie ilustruje tego konkretnego tekstu, tylko ogólny temat „AI”. To jest problem niezauważalny w pojedynczym wpisie, ale gęstniejący w skali strony. Po dwudziestu wpisach wszystkie obrazy wyglądają jak ilustracje do jednego artykułu o AI — bo nie odróżniają się od siebie tematycznie.

Każda z tych trzech pułapek prowadzi do tego samego efektu — obraz przestaje pełnić swoją funkcję. A funkcja obrazu we wpisie nie ogranicza się do dekoracji.

Co obraz robi dla wpisu, czego tekst nie robi

Trzy konkretne role, które dobry obraz pełni — i które generyczny obraz traci.

Pierwsza — sygnał rozpoznawalności wizualnej. Czytelnik, który widzi okładkę twojego wpisu na Twitterze, LinkedInie albo Pinterescie, ma sekundę na decyzję czy kliknie. Generyczny obraz nie wyróżnia się — przelatuje przez timeline. Charakterystyczny obraz zatrzymuje wzrok. Ten konkretny mechanizm decyduje o większości ruchu z mediów społecznościowych.

Druga — kompresja semantyczna. Dobry obraz przekazuje jedną konkretną ideę z wpisu w formie wizualnej. Wpis o pułapkach polerowania AI — okładka pokazująca konkretny moment, w którym tekst traci charakter. Wpis o tłumaczeniach automatycznych — okładka pokazująca konkretną różnicę między językami. Generyczny obraz tej kompresji nie robi, bo nic konkretnego nie pokazuje.

Trzecia — ślad redakcyjny. Strona, której każdy obraz jest zaprojektowany pod konkretny wpis, sygnalizuje czytelnikowi że redakcja przemyślała każdy element. Strona z generycznymi obrazami sygnalizuje coś przeciwnego — że obraz jest „wymaganym elementem”, a nie częścią narracji. Drugi sygnał obniża zaufanie do całej treści, niezależnie od jej jakości.

To są trzy role, które obraz pełni dla czytelnika. Drugi AI — model językowy odwiedzający twoją stronę — czyta inaczej. Dla niego obraz jest niemy, jeśli nie towarzyszą mu słowa, które go opisują. I tu zaczyna się warstwa, którą rzadko porusza polski poradnik o generowaniu obrazów AI.

Alt-tekst jako warstwa agent-readiness

W filarze pierwszym agent-readiness pisałem, że agent czytający stronę nie widzi obrazów — widzi tylko ich opisy. Atrybut alt w tagu <img> jest pierwszą warstwą tej widzialności, ale nie jedyną. Drugi AI w 2026 roku korzysta z trzech źródeł informacji o obrazie:

- Atrybut

alt— krótki opis, tradycyjnie przeznaczony dla dostępności - Atrybut

titlei otaczający tekst — kontekst, w którym obraz się pojawia - Schema.org

ImageObjectz polemcaption— strukturalny opis dla bardziej zaawansowanych agentów

Generatory obrazów AI często generują również alt-teksty razem z obrazami. To jest wygodne, ale ma jedną wadę — generowane alt-teksty opisują to, co widać na obrazie (np. „robot pisze na klawiaturze przy biurku”), a nie to, co obraz znaczy w kontekście wpisu (np. „pierwszy AI generuje treść, której potem czyta drugi AI”).

Ta różnica jest fundamentalna. Drugi AI, czytając alt-tekst opisujący zawartość obrazu, dostaje informację techniczną. Czytając alt-tekst opisujący ideę obrazu, dostaje sygnał, jak ten obraz pasuje do tekstu. To drugie jest tym, co wyróżnia stronę agent-ready od strony, która tylko ma generowane obrazy.

Praktyczna zasada: alt-tekst pisz sam, nawet jeśli obraz jest generowany przez AI. To jest piętnaście sekund pracy na obraz, ale różnica między obrazem widzianym przez agenta jako „kolejna ilustracja AI” a obrazem widzianym jako „ilustracja konkretnej tezy z tego wpisu”.

Watermarking, AI Act, prawa autorskie

Trzy obszary regulacyjne, których nie da się tu rozstrzygnąć, ale które warto sygnalizować.

Watermarking. AI Act, który wszedł w fazy stosowania w 2025 i 2026 roku, w niektórych zastosowaniach wymaga oznaczania treści generowanych przez AI w sposób umożliwiający ich wykrycie. Niektórzy operatorzy (Adobe Firefly, Google Imagen) wbudowują kryptograficzne znaki wodne w generowane obrazy. Inni nie. Z perspektywy właściciela strony — w 2026 roku watermarking jest jeszcze raczej propozycją niż wymogiem produkcyjnym, ale obserwować warto.

Prawa autorskie. Status praw autorskich do obrazów generowanych przez AI jest w 2026 roku wciąż przedmiotem orzecznictwa. W USA US Copyright Office stoi na stanowisku, że „obraz wygenerowany wyłącznie przez AI” nie podlega ochronie autorskiej. W UE sytuacja jest mniej jednoznaczna — interpretacje sądów krajowych różnią się. Praktyczna konsekwencja: jeśli generujesz obraz dla swojej strony, prawdopodobnie nie masz do niego pełnych praw autorskich w klasycznym sensie. To rzadko jest problem przy publikacji we własnym blogu — staje się problemem dopiero, kiedy ktoś inny ten obraz wykorzysta i obie strony zaczną się spierać o własność.

Trening modeli na cudzych obrazach. Większość dużych generatorów obrazów AI była trenowana na danych zawierających chronione prawem autorskim obrazy z internetu. Toczą się procesy sądowe (Getty vs Stability AI, artyści vs Midjourney) — bez prawomocnych orzeczeń w 2026 roku. Adobe Firefly w komunikacji marketingowej eksponuje fakt, że był trenowany wyłącznie na licencjonowanych obrazach Adobe Stock. Inni operatorzy unikają tej dyskusji.

Jak generować obrazy, żeby działały w obu warstwach

Trzy techniki praktyczne, które razem podnoszą jakość obrazów i ich wartość dla agent-readiness.

Pierwsza — pisz prompty pod konkretną tezę wpisu, nie pod ogólny temat. Nie „WordPress dashboard”, tylko „pęknięty laptop z dwoma ekranami pokazującymi dwie różne wersje tej samej strony”. Konkretność promptu jest jedną z największych dźwigni jakości — i jednocześnie tym, co odróżnia generyczne obrazy od specyficznych.

Druga — pisz alt-teksty sam, opisując ideę, nie zawartość. Jeden zdanie. Konkretne. Powiązane z tezą wpisu. Nie „robot pisze na laptopie”, tylko „symboliczne przedstawienie pierwszego AI piszącego treść, której potem czyta drugi AI”.

Trzecia — używaj jednego stylu wizualnego dla całej serii, ale różnicuj kompozycje. Spójność stylistyczna serii jest wartością. Powtarzalność kompozycji w obrębie jednego wpisu — nie. Jeśli twoja seria ma trzy okładki w identycznej kompozycji (robot na środku, gradient w tle, jeden duży tekst), to nie jest spójność, to jest powtarzalność. Spójność to identyczna paleta kolorów i estetyka, ale różne kompozycje.

Złota zasada — generuj obraz, redaguj alt-tekst

Najprostsza reguła, do której sprowadza się większość praktyki w tym wpisie: AI może wygenerować obraz, ale alt-tekst napisz sam. Bo obraz dla człowieka jest dekoracją albo sygnałem rozpoznawalności. Alt-tekst dla agenta jest jedynym sposobem, w jaki ten obraz w ogóle istnieje. I jeśli agent dostaje generyczny opis, traktuje obraz jako generyczną ilustrację. Jeśli dostaje opis powiązany z tezą wpisu, traktuje go jako część argumentacji.

Następny wpis w mini-serii dotyczy SEO — gdzie pytanie o cytowalność, klastrowanie tematów i strategię treści w świecie zero-click łączy w sobie wszystko, co poruszaliśmy w poprzednich pięciu wpisach.