Większość polskich poradników o AI do tworzenia treści odpowiada na jedno pytanie: jak za pomocą ChatGPT albo Claude’a napisać artykuł szybciej niż samodzielnie. To jest sensowne pytanie. Generatory potrafią dziś rzeczy, które jeszcze rok temu wymagały godzin pracy redakcyjnej. Polerują składnię, tłumaczą, sugerują tytuły, generują meta-opisy. Dla właściciela strony, marki piszącej bloga firmowego, redakcji albo agencji content marketingowej to są realne narzędzia, których warto używać.

Tylko że to pytanie zadaje się od dwóch lat tymi samymi słowami. A świat, w którym powstaje treść, w międzyczasie się zmienił.

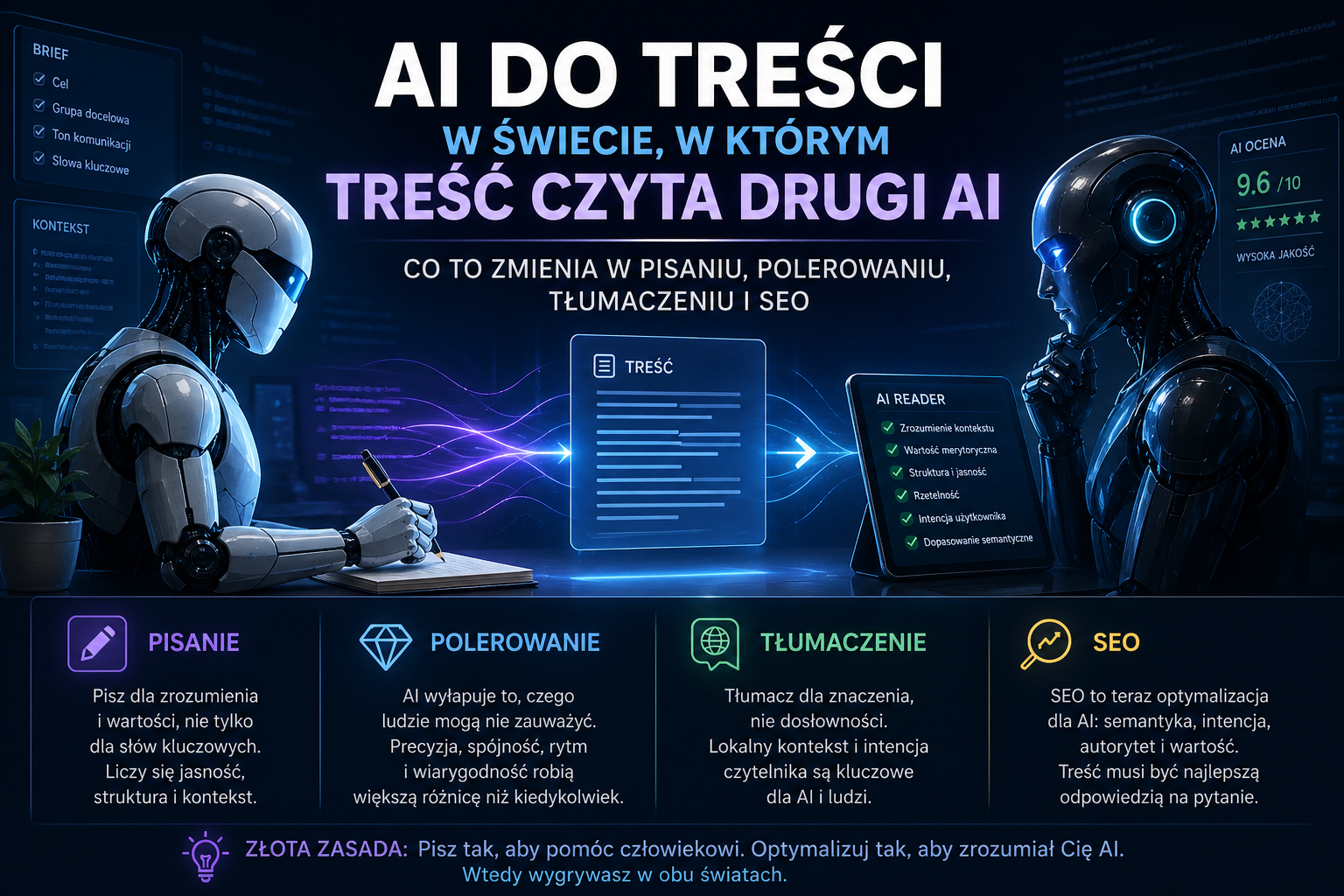

Zmiana jest taka: treść, którą publikujesz na swojej stronie, coraz częściej nie trafia bezpośrednio do człowieka. Najpierw trafia do innego AI — wyszukiwarki agentowej, modelu odpowiadającego na pytanie użytkownika, agenta wykonującego zadanie w jego imieniu. To ten drugi AI decyduje, czy twoja treść zostanie zacytowana, jak zostanie streszczona, jakim głosem będzie przedstawiona dalej. Pisanie z pomocą AI jest jedną stroną tej samej historii. Druga strona — czytanie twojej treści przez AI — w dyskusjach o tworzeniu treści jest zaskakująco rzadko obecna.

To jest pierwszy wpis sześcioczęściowej mini-serii o AI do tworzenia i utrzymania treści. Zamiast typowego przewodnika po narzędziach, którego polski internet ma już dziesiątki, ta mini-seria pyta o coś, co rzadko się pojawia w pierwszej warstwie. Jak pisać tekst, kiedy pierwszym czytelnikiem jest model językowy. Jak polerować, kiedy gładkość zaciera ślad autora. Jak tłumaczyć, kiedy wersję językową wybiera agent. Jak generować obrazy, kiedy ich oryginalność decyduje o wartości treningowej. Jak robić SEO w świecie, w którym połowa pytań nie kończy się kliknięciem.

Pierwszy AI pisze, drugi AI czyta

Przez ostatnie dwa lata ChatGPT, Claude, Gemini i ich konkurenci przeniknęli do przepływu pracy redakcyjnej w sposób, który dla większości twórców treści jest dziś oczywisty. Pierwsza wersja artykułu generowana w pięć minut. Polerowanie składni jednym promptem. Tłumaczenie z polskiego na angielski w jakości lepszej niż większość freelancerów potrafiła oferować jeszcze w 2022. Generowanie meta-opisów, tytułów, alt-tekstów do obrazów. To jest pierwszy AI w historii treści — model językowy w roli pomocnika autora.

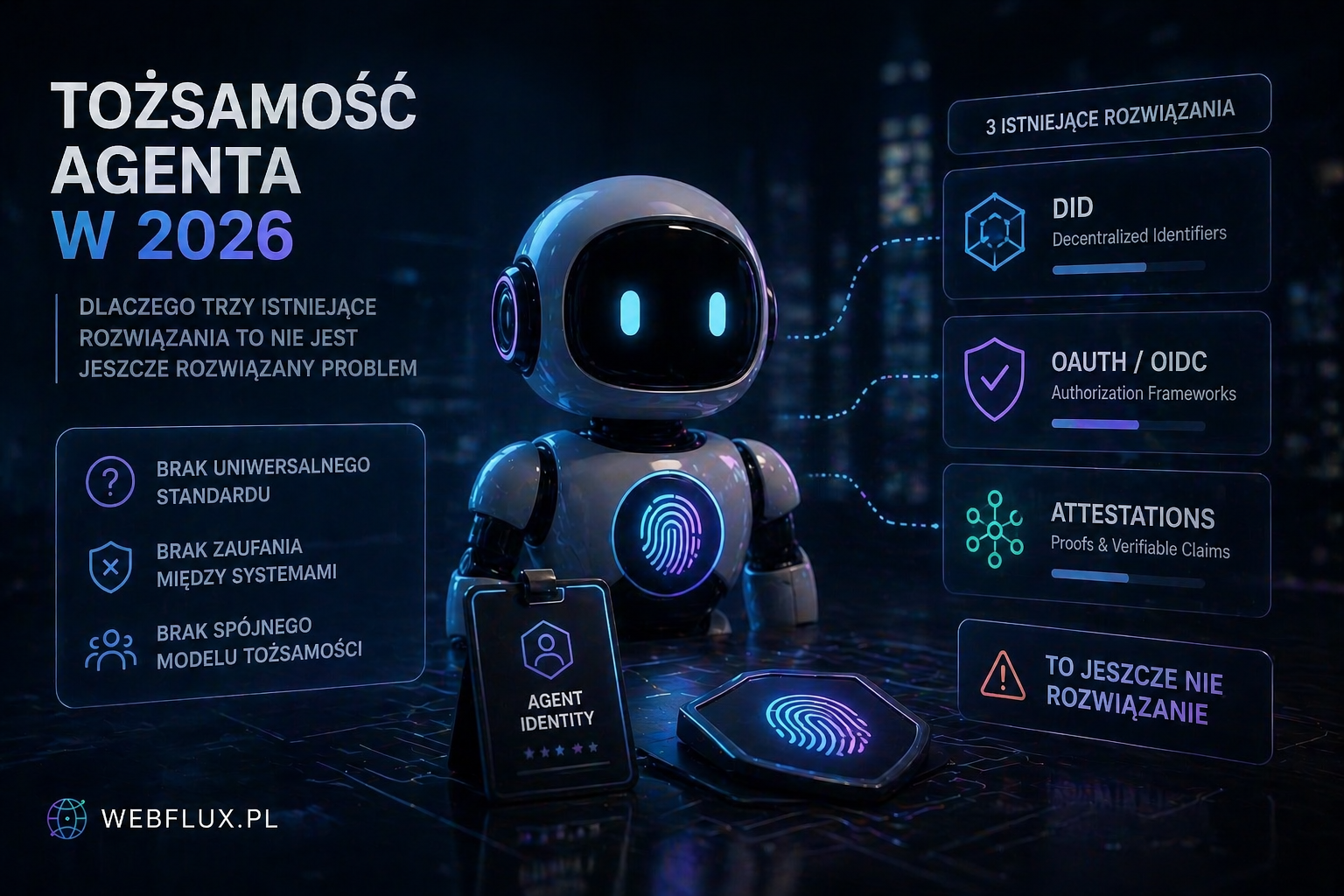

Drugi AI pojawił się ciszej. Najpierw jako wyszukiwarka, która zaczęła odpowiadać własnymi zdaniami zamiast pokazywać linki. Potem jako asystent w przeglądarce. Potem jako agent zakupowy, który nie pyta użytkownika o szczegóły, tylko sam je znajduje na stronie. W kwietniu 2026 nie jest już dyskusyjne, czy ten drugi AI istnieje. Pytanie brzmi tylko, jak duża część ruchu na twojej stronie jest dziś jego ruchem — i co on z twoją treścią robi.

Pisałem o tej drugiej stronie szeroko w serii Agent-ready, w sześciu filarach pokazujących, co decyduje o tym, czy agent w ogóle dostrzega twoją stronę i jak ją interpretuje. Tu, w tej mini-serii, robimy krok bliżej do treści — bo agent-readiness jest warstwą strony, ale co konkretnie na tej stronie pisze, jak to brzmi, w jakim języku jest dostępne, jakie obrazy mu towarzyszą — to wszystko też jest częścią tego, co agent czyta. I jeśli w tej warstwie posługujemy się pierwszym AI (do tworzenia), warto wiedzieć, jak to wpłynie na drugiego AI (do czytania).

Cztery rzeczy, które zmienia obecność drugiego AI

Pierwsza — gładkość AI tworzy nowy problem rozpoznawalności. Tekst polerowany przez ChatGPT albo Claude’a brzmi poprawnie — i to jest jego problem. Bo poprawność jest dziś tania. Każdy może ją wygenerować. Sygnałem rozpoznawalności w tekście staje się to, co od niej odbiega — charakterystyczny rytm autora, lokalne odniesienia, niespodziewane zwroty. Dokładnie te rzeczy, które AI w polerowaniu najczęściej wycina, bo „brzmiały dziwnie”.

Druga — dane strukturalne zaczynają wyrównywać szanse. Tekst napisany przez początkującego autora, ale uzupełniony solidnym JSON-LD, schema.org Article, otoczony kanonicznym hreflangiem, opisany w llms.txt, jest dla agenta bardziej wiarygodny niż genialny tekst bez tych warstw. To rozróżnienie zaciera tradycyjną hierarchię „świetna treść > przeciętna treść”. W świecie, w którym czytelnikiem jest model, kontekst techniczny waży tyle samo, co merytoryczna jakość.

Trzecia — wielojęzyczność staje się decyzją architekturalną, nie tłumaczeniową. Kiedy ChatGPT albo Perplexity dostaje pytanie po polsku o produkt opisywany na twojej stronie po angielsku, to nie człowiek decyduje, którą wersję językową dostać — decyduje to agent na podstawie hreflang, atrybutów lang, danych strukturalnych. Tłumaczenie automatyczne to tylko część pracy. Reszta to architektura wielojęzyczna, którą warto traktować jak warstwę agent-readiness.

Czwarta — SEO przestaje być optymalizacją pod kliknięcia. Coraz większa część odpowiedzi modeli AI nie kończy się przejściem na twoją stronę. Użytkownik dostaje streszczenie, cytat, ewentualnie listę źródeł — ale często bez kliknięcia. To jest „zero-click” w nowej skali. Pytanie nie brzmi już „jak być wysoko w Google”, tylko „jak być cytowanym przez modele”. To jest dwie różne dyscypliny, choć korzystają z części tych samych narzędzi.

Te cztery zmiany przewijają się przez kolejne pięć wpisów tej mini-serii. Każdy temat — generowanie, polerowanie, tłumaczenia, obrazy, SEO — dostaje warstwę „pierwszego AI” (jak go używamy do tworzenia) i warstwę „drugiego AI” (jak nasza treść jest potem czytana). Bez tej drugiej warstwy mini-seria byłaby kolejnym poradnikiem o ChatGPT do pisania bloga. Z nią — staje się czymś, czego polski internet jeszcze za bardzo nie ma.

Czego nie znajdziesz w tej mini-serii

Żeby było uczciwie, kilka rzeczy, których ta mini-seria świadomie nie pokrywa.

Nie znajdziesz tu prostego rankingu „najlepszych narzędzi AI do treści”. W każdym wpisie wymieniam narzędzia — i polskie, i globalne — ale opisuję mechanizm ich działania, nie sprzedaję rekomendacji. Wybór narzędzia to twoja decyzja. Moja rola to pokazać, czego od niego oczekiwać.

Nie znajdziesz tu obietnicy, że AI „zastąpi” pisarzy, redakcje albo agencje content marketingowe. To jest temat osobnej mini-serii — o ekonomice WordPressa w erze AI. Tu zajmujemy się warstwą operacyjną, nie strategicznym przewidywaniem.

Nie znajdziesz tu też prostych odpowiedzi na pytania prawne — prawa autorskie do tekstów generowanych, AI Act, watermarking. Każde z tych zagadnień zasługuje na osobne potraktowanie. Tu sygnalizuję je tam, gdzie wpływają na konkretne decyzje produkcyjne, ale nie udaję, że je rozstrzygam.

Sześć wpisów, jeden wątek

Pełna mapa mini-serii:

1. Manifest — ten wpis. Co zmienia obecność drugiego AI w pracy nad treścią.

2. AI do generowania artykułów — kiedy działa, kiedy zostawia ślady, kiedy zabija ruch. Polskie i globalne narzędzia. Jak wzmacniać generowane teksty danymi strukturalnymi.

3. Polerowanie i edycja tekstów — kiedy AI ratuje tekst, a kiedy go niszczy. Sekcja o gładkości jako sygnale dla modeli.

4. Tłumaczenia automatyczne — kiedy DeepL i konkurencja wystarczą, kiedy nie. Architektura wielojęzyczna jako warstwa agent-readiness.

5. Generowanie obrazów do wpisów — między oryginalnością a stockowym wrażeniem. Alt-teksty, watermarking, polityka.

6. AI w SEO i meta-tagach — od meta-opisów do strategii treści w świecie zero-click.

Każdy wpis stoi samodzielnie — można czytać wybiórczo. Razem tworzą obraz pracy nad treścią, który uwzględnia obie strony tej samej historii: tę, w której AI pomaga ci pisać, i tę, w której inny AI czyta to, co napisałeś.

To jest pierwsza mini-seria w kategorii AI w WordPressie. Następne — o budowie strony, administracji, workflow redakcyjnym, ekonomice i zastosowaniach branżowych — powstają stopniowo. Jeśli jesteś nowy w temacie agentic web, warto najpierw przejrzeć hub Agent-readiness — bo cała mini-seria zakłada, że pojęcie „treść jest czytana przez agenty” jest dla czytelnika oczywiste. Tam jest to wytłumaczone od zera.

Zaczynamy od wpisu o generowaniu artykułów. Bo to jest najmasowsze zastosowanie pierwszego AI — i równocześnie miejsce, w którym najwyraźniej widać konsekwencje obecności drugiego.