W poprzednich pięciu wpisach tej serii budowaliśmy warstwę po warstwie — od najbardziej fundamentalnej (czytelność) do najbardziej eksperymentalnej (tożsamość). Każdy filar odpowiadał na inne pytanie techniczne. Filar szósty, ostatni w tej sześciofilarowej mapie, odpowiada na pytanie zupełnie innej natury — nie technicznej, tylko biznesowej. Brzmi ono tak: skoro wpuszczasz agentów na swoją stronę (albo nie), skoro dałeś im możliwość działania (albo nie), skoro zainwestowałeś w czytelność, dane, sygnały, tożsamość — co konkretnie z tego masz.

To nie jest pytanie marginalne. Każdy z poprzednich pięciu filarów wymaga nakładu pracy, czasem zasobów, czasem decyzji biznesowych. Bez odpowiedzi na pytanie „co z tego mam” cała praca jest inwestycją w niewiadomą. A z perspektywy marca-kwietnia 2026, kiedy ruch agentowy rośnie, kiedy Amazon pozywa Perplexity, kiedy OpenAI podpisuje umowy licencyjne z wydawcami, kiedy Cloudflare wypuszcza pay-per-crawl — nie ma już komfortu „zobaczymy, jak się to rozwinie”. Trzeba podjąć decyzję, jaką politykę ekonomiczną masz wobec agentów, albo decyzja zostanie podjęta za ciebie przez rynek.

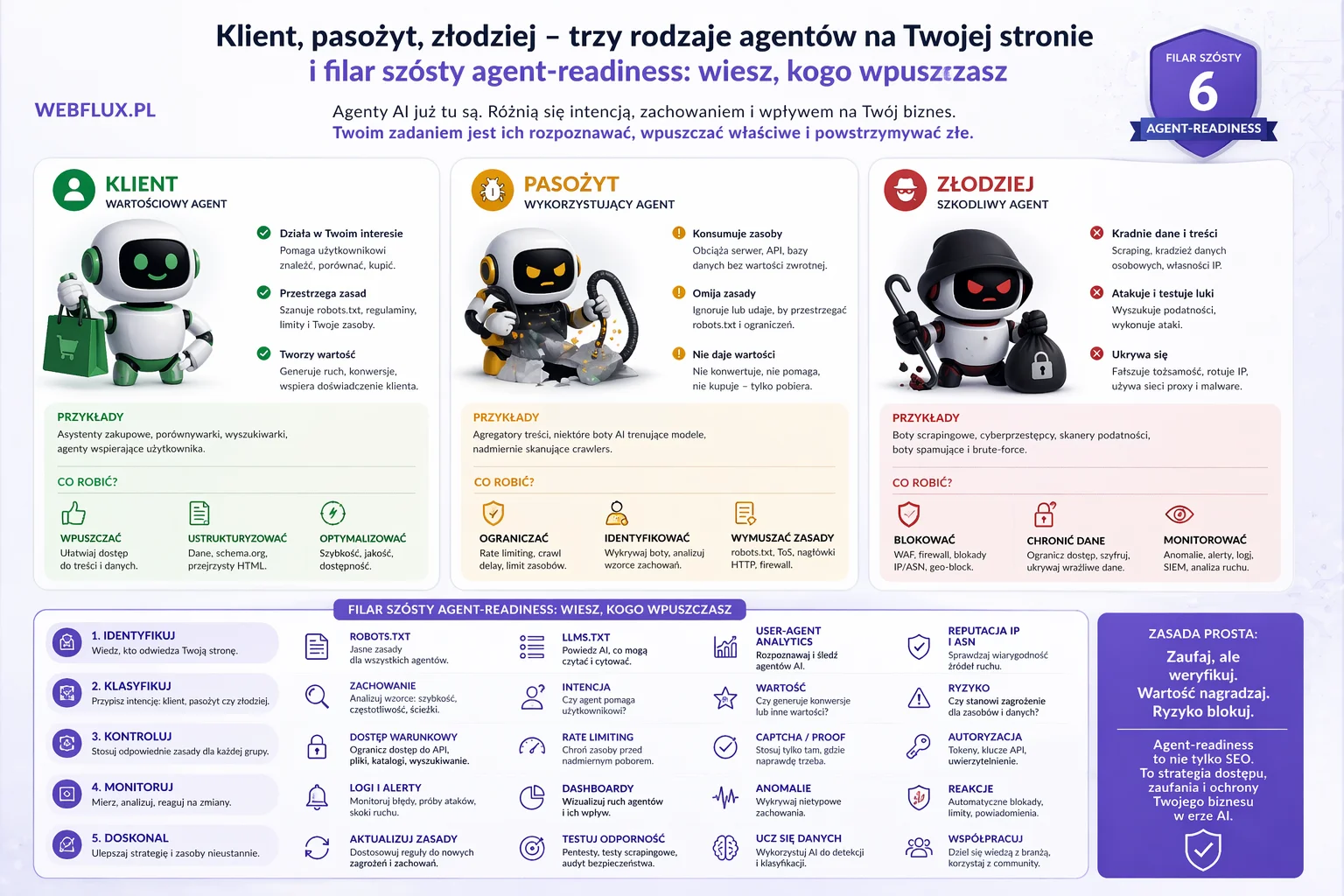

Propozycja, którą zrobię w tym wpisie, jest prosta w konstrukcji, ale dosłowna w konsekwencjach. Agent, który odwiedza twoją stronę, jest zawsze jednym z trzech. Klientem — jeśli przynosi ci realną wartość. Pasożytem — jeśli konsumuje twoje zasoby bez wzajemności. Złodziejem — jeśli czerpie z twojej pracy coś, do czego nie ma prawa. Filar szósty agent-readiness polega na rozpoznaniu, który agent jest którym, i wyciągnięciu z tego konsekwencji. Bo bez tego rozpoznania twoja strona jest tylko darmowym magazynem dla wszystkich trzech typów — i tych, od których masz coś, i tych, którzy tylko biorą.

Kiedy agent jest klientem

Zacznijmy od najłatwiejszego. Agent jest klientem wtedy, kiedy jego wizyta kończy się wartością dla twojej strony. Wartość nie musi być bezpośrednia — może być odroczona, może być pośrednia, ale musi istnieć w jakiejś mierzalnej formie.

Najprostszy przypadek — agent, który finalizuje transakcję. Użytkownik prosi swojego agenta o zakup konkretnego produktu, agent odwiedza twój sklep, sprawdza dostępność, składa zamówienie. W tym scenariuszu agent jest kanałem sprzedaży — takim samym jak wyszukiwarka Google, która przyprowadziła klienta, albo jak reklama na Facebooku. Różnica jest taka, że kanał agentowy wymaga od twojej strony innej warstwy przygotowania (o czym była cała poprzednia seria tych wpisów), ale ekonomika jest ta sama. Klient kupuje, ty zarabiasz.

Drugi przypadek — agent, który przyprowadza użytkownika. Ktoś pyta Perplexity albo ChatGPT o rekomendację, agent cytuje twoją stronę jako źródło, użytkownik klika link, wchodzi na twoją stronę. Klasyczny SEO ruch, tylko przez nowego pośrednika. To też jest model klienta — agent jest tym, który przyprowadził wizytę, która może się skonwertować.

Trzeci przypadek — agent, który buduje zaufanie do twojej marki. Nawet jeśli konkretna wizyta agenta nie kończy się transakcją, to że agent wie o istnieniu twojej firmy, że cytuje cię w kontekście branżowym, że rekomenduje jako eksperta — to jest wartość marketingowa. Pośrednio, ale realnie, wpływa na to, że kiedy ten sam użytkownik za miesiąc będzie szukać konkretnego produktu albo usługi, twoja marka pojawi się w polu uwagi. Najstarszy model reklamowy — budowa rozpoznawalności — tylko z nowym pośrednikiem.

Te trzy scenariusze mają wspólną cechę: wymiana wartości jest dwustronna. Agent dostaje od ciebie informację albo transakcję, ty dostajesz od niego ruch, sprzedaż albo atrybucję. Tak wygląda zdrowa ekonomia ruchu agentowego, i tak będzie wyglądać znaczna część przyszłości agentic commerce — jeśli przygotujesz się tak, żeby agenta-klienta rozpoznać i go wspierać.

Pełny przewodnik po agentic commerce z perspektywy protokołów (UCP, ACP, AP2), które mają docelowo ustandaryzować tę warstwę transakcyjną, jest w hubie Universal Commerce Protocol. Tam rozpisuję konkretnie, jak agent-klient ma wyglądać w ekosystemie WooCommerce, jakie narzędzia się pojawiają i co z nich wynika dla sklepu.

Kiedy agent jest pasożytem

Pasożyt w języku biologii to organizm, który żyje na koszt gospodarza, nie dając mu nic w zamian. To jest dokładnie ten termin, którego nie lubiłem używać podczas pisania tego wpisu — ale żaden inny nie opisuje precyzyjniej tego, co się dzieje w jednej konkretnej warstwie agentowego ruchu.

Agent-pasożyt to agent, który konsumuje twoje zasoby bez wzajemności. Pobiera treść, którą napisałeś, ale nie przyprowadza ruchu. Nie cytuje twojej strony, bo odpowiada użytkownikowi z parametrów modelu, który został wytrenowany między innymi na twoich tekstach. Nie klika w twoje linki, bo w ogóle nie wchodzi w interakcję z warstwą monetyzacji twojej strony. Ale każda wizyta tego agenta kosztuje cię coś — bandwidth, cykle CPU, miejsce w logach serwera.

Najlepszym przykładem pasożyta jest crawler trenujący modele bez atrybucji. GPTBot w 2023 roku, zanim OpenAI zmieniło politykę. Bytespider w 2024. Crawlery, które zbierały treści do trenowania modeli, a potem te modele odpowiadały na pytania użytkowników używając twojej wiedzy — bez twojej zgody, bez rekompensaty, bez wzmianki. Ty napisałeś artykuł o tym, jak ugotować pierogi. Model nauczył się z twojego artykułu. Użytkownik zapytał model, jak ugotować pierogi. Model odpowiedział, cytując fakty z twojego artykułu, ale nie wymieniając go. Twoja praca zasila odpowiedź, ale ty nie dostajesz ani ruchu, ani atrybucji.

Co ważne — nie każdy bot AI jest pasożytem. GPTBot pobierający treść do treningu to jedno. ChatGPT-User, który odwiedza twoją stronę w imieniu konkretnego użytkownika w konkretnej rozmowie, cytujący twoje źródło w odpowiedzi, kierujący ruch do ciebie — to już klient, albo przynajmniej kandydat na klienta. To rozróżnienie jest kluczowe, bo większość operatorów AI (OpenAI, Anthropic, Perplexity) używa różnych user-agentów dla różnych celów. Rozsądna polityka wobec pasożytów nie wyklucza dopuszczenia klientów — to dwie różne decyzje, choć dotyczą tej samej firmy.

Na warstwie praktycznej problem pasożyta sprowadza się do jednego pytania: jak odzyskać coś z tej wymiany jednostronnej. Trzy drogi, które rynek zaczął testować w ostatnich miesiącach:

Blokada — najprostsza, zero-sum. Używasz robots.txt, Cloudflare AI Crawl Control, WAF-a, żeby nie wpuścić botów trenujących. Tracisz potencjalny zasięg (jeśli twoja treść nie będzie w modelach, nie pojawi się w odpowiedziach), ale nie tracisz zasobów. Sensowne dla wydawców, którzy wartość zarabiają z reklam, i dla stron z treściami eksperckimi, których nie chcą rozdawać.

Licencjonowanie — umowa komercyjna. OpenAI podpisało w ostatnich kwartałach umowy z Associated Press, Axel Springer, Dotdash Meredith, Vox Media, News Corp i innymi dużymi wydawcami. Model: wydawca daje zielone światło na używanie treści do treningu, OpenAI płaci umówioną kwotę. Dla małych stron ten model jest niedostępny — nie masz jak negocjować z OpenAI jako pojedynczy bloger. Ale zaczynają się pojawiać platformy pośredniczące (Tollbit, ScalePost), które agregują treści mniejszych wydawców i negocjują zbiorczo.

Pay-per-crawl — funkcja Cloudflare, która pozwala zażyczyć sobie mikropłatności od AI-crawlerów za każde pobranie treści. Jest to najbardziej egalitarna droga, bo nie wymaga bycia dużym wydawcą — każdy, kto ma stronę za Cloudflare, może to włączyć. Ekonomika jest na razie niepewna (crawler albo zgodzi się zapłacić, albo po prostu odejdzie), ale kierunek jest interesujący. Jeśli pay-per-crawl przyjmie się na szerszą skalę, stanie się to ekwiwalentem micropayments, o których mówiono od dekady — tylko że tym razem płatnikiem nie jest człowiek, tylko model AI.

Dla szerszej perspektywy na to, co się dzieje w ekosystemie bezpieczeństwa i ekonomii ruchu agentowego, polecam CyberFlux.pl — tam prowadzę osobny wątek o tym, jak agenci zmieniają sposób myślenia o całej infrastrukturze webowej, nie tylko o konkretnych atakach.

Kiedy agent jest złodziejem

Termin „złodziej” jest mocniejszy niż „pasożyt” i używam go świadomie, bo chodzi o inną kategorię zachowań. Pasożyt bierze to, co jest dostępne publicznie — może bez wzajemności, ale bez łamania zasad. Złodziej bierze to, do czego zasady mówią, że nie ma prawa.

Kazus, który najlepiej ilustruje tę różnicę, to wspomniany wcześniej spór Amazona z Perplexity. Amazon publicznie, w robots.txt, mówił: „nie, ChatGPT i inne agenty zakupowe, nie wolno wam robić zakupów na moim sklepie”. Perplexity zignorowało to, a kiedy Amazon wprowadził techniczne blokady, Perplexity w ciągu 24 godzin zmieniło user-agent swojego agenta Comet, żeby maskował się jako zwykły Chrome. To już nie jest pasożyt — to jest agent, który aktywnie obchodzi politykę właściciela strony. Sąd federalny w San Francisco w marcu 2026 wydał wstępne zabezpieczenie na korzyść Amazona. Amazon nie skończył argumentu o tym, że agent odbiera mu przychody reklamowe — ale sąd wstępnie przyznał rację, że nieautoryzowany dostęp to problem.

Ale „złodziej” w kontekście filaru 6 nie jest tylko o sprawach sądowych. Są trzy powszechniejsze scenariusze, które warto znać.

Pierwszy — agent, który podszywa się pod człowieka. User-agent spoofing, o którym pisałem w wpisie o tożsamości agenta. Agent deklaruje się jako Chrome, żeby uniknąć wykrycia. Przez to korzysta z twojej strony jak człowiek, mimo że nie jest człowiekiem, a ty rozliczasz się ze swoimi reklamodawcami na podstawie liczby ludzkich odwiedzin. Agent podszywający się kradnie ci nie tyle treść, ile legitymację — wygląda na metrykę, która nią nie jest.

Drugi — agent, który wykorzystuje zasoby kosztowne bez podstawy. Dotyczy to stron, które oferują darmowe narzędzia zasobochłonne — kalkulatory, konwertery, API testowe, proste generatory. Agent, który używa tego narzędzia tysiące razy dziennie w imieniu użytkowników, przekracza granice normalnego użycia. Model ekonomiczny narzędzia zakładał, że koszt hostingu rozkłada się na wielu ludzi, którzy korzystają czasem — nie na jednego agenta, który korzysta w każdej sekundzie. Różnica między użyciem normalnym a nadużyciem jest ilościowa, ale skutki są jakościowe.

Trzeci — agent, który ekstrahuje dane, które mają być udostępniane z ograniczeniami. Katalog cen dostępny na stronie produktu. Baza kontaktów, którą trzeba „wyklikać”. Listingi, które celowo są paginowane tak, żeby konkurencja nie mogła ich zescrapować. Agent potrafi zrobić to wszystko w godziny, zamiast w dni potrzebne człowiekowi. Dane, które miały być dostępne, ale nie łatwe do zebrania, stają się dostępne i łatwe.

Co zrobić z agentem-złodziejem? Trzy poziomy reakcji, proporcjonalne do skali i intencji:

Techniczne — WAF, rate limiting, Cloudflare Bot Management. Dla większości mniejszych stron to jest wystarczająca warstwa. Kiedy zauważysz, że konkretny user-agent generuje anomalny ruch, blokujesz go. Jeśli wraca z innym user-agentem, blokujesz po pattern’ie zachowania (np. po szybkości żądań).

Prawne — wezwania do zaprzestania, pozwy. Tylko dla dużych stron z realnymi stratami. Amazon vs Perplexity jest precedensem, ale koszt takiego postępowania liczy się w dziesiątkach tysięcy dolarów. Dla większości stron to nieosiągalne.

Reputacyjne — publiczne opisanie zachowania konkretnego operatora agenta. Jeśli firma X notorycznie łamie zasady twojej strony, napisanie o tym publicznie (tekst blogowy, wpis w branżowej publikacji) bywa skuteczniejsze niż blokada techniczna. Firmy AI są wrażliwe na reputację w społeczności deweloperów, i publiczne opisanie „oto jak firma X ignoruje robots.txt” może wpłynąć na ich politykę.

Jak rozpoznać, który jest który

Klasyfikacja na klienta, pasożyta i złodzieja nie jest abstrakcyjna. Można ją praktycznie zastosować do każdej wizyty agenta na twojej stronie, używając trzech pytań:

Czy ta wizyta przynosi mi wartość? Jeśli tak, klient. Wartość może być transakcją, ruchem, atrybucją, pozycjonowaniem marki.

Czy ta wizyta konsumuje zasoby bez wzajemności? Jeśli tak, pasożyt. Zasoby to bandwidth, CPU, miejsce w logach, koszt hostingu.

Czy ta wizyta łamie moje zasady? Jeśli tak, złodziej. Zasady to robots.txt, warunki użytkowania, ograniczenia techniczne.

Warto zauważyć, że ten sam agent może być różnym typem w różnych momentach. ChatGPT-User, który odwiedza twoją stronę w odpowiedzi na zapytanie użytkownika o konkretny produkt, jest klientem (potencjalnym). Ten sam agent odwiedzający stronę z narzędziem kalkulatora w imieniu tysiąca użytkowników dziennie staje się pasożytem (bo narzędzie nie miało być tak używane). Jeśli obchodzi twoje blokady — staje się złodziejem.

Dlatego filar 6 nie sprowadza się do prostego „wpuść wszystkich” albo „zablokuj wszystkich”. Sprowadza się do segmentacji ruchu agentowego — rozróżnienia user-agentów, ich celów, ich zachowania, i dostosowania polityki do każdego segmentu.

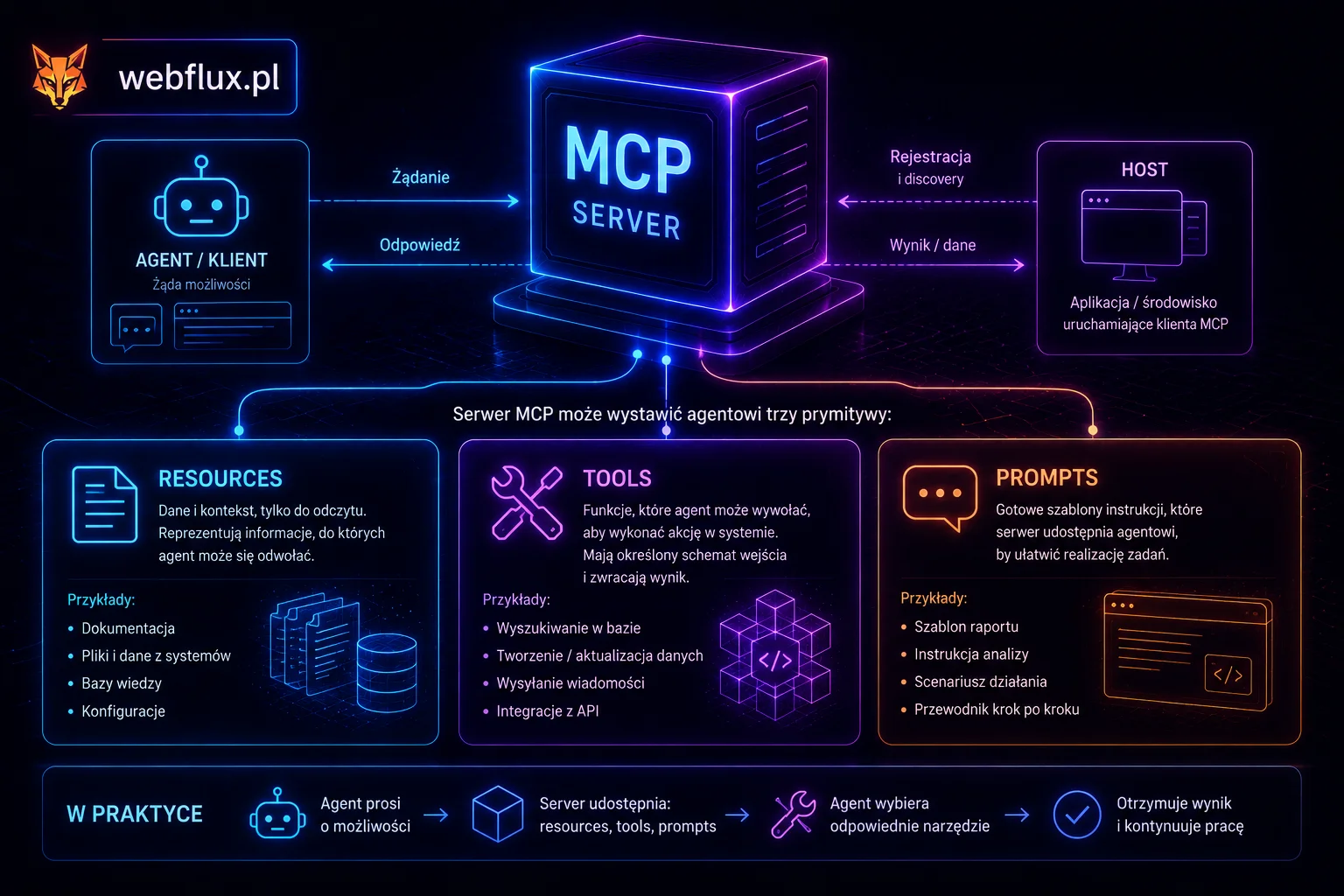

Klient, pasożyt, złodziej — trzy rodzaje agentów

Co z tego wynika

Filar szósty zamyka sześciofilarową mapę agent-readiness, którą budowaliśmy przez całą tę serię. Każdy z wcześniejszych filarów był odpowiedzią na pytanie techniczne — czytelność, dane, sygnały, działanie, tożsamość. Filar szósty jest odpowiedzią na pytanie biznesowe, i dlatego jest też najbardziej otwarty. Nie ma jednej dobrej odpowiedzi, bo zależy ona od tego, kim jesteś, co sprzedajesz, jakie masz koszty, jaką masz tolerancję na ryzyko.

Ale są trzy rzeczy, co do których nie ma wątpliwości.

Po pierwsze — nic nie rób, a decyzja zostanie podjęta za ciebie. Jeśli nie masz polityki wobec agentów, twoja polityka brzmi „każdy może wszystko, na mój koszt”. To jest polityka, którą rynek już zaczyna uznawać za naiwną.

Po drugie — rozróżniaj. Agent nie jest jednolitą kategorią. ChatGPT-User i GPTBot to dwa różne byty z tą samą marką. PerplexityBot i Claude-User mają różne ekonomie. Segmentacja ruchu agentowego jest pierwszą pracą, którą warto zrobić, zanim zaczniesz decydować co z kim zrobić.

Po trzecie — strategia nie musi być dziś ostateczna. Rynek zmienia się szybko, standardy jeszcze się nie wykrystalizowały, pay-per-crawl może przyjmować się lub nie, licencjonowanie może demokratyzować się lub nie. Decyzja, którą podejmiesz w kwietniu 2026, nie musi być decyzją na lata. Ale musi być decyzją podjętą świadomie, a nie zostawioną przypadkowi.

Co dalej

To jest ostatni wpis koncepcyjny w serii sześciofilarowej. Został jeszcze wpis praktyczny — Divi-towarzysz filaru 6, który pokaże jak konkretnie ustawić pay-per-crawl przez Cloudflare, jak analizować ruch agentowy w logach, jak rozróżniać klientów od pasożytów w praktyce narzędziowej. Potem wpis zamykający całą serię — podsumowanie sześciu filarów, ranking priorytetów wdrożenia, i konkretny plan, od czego zacząć, jeśli chcesz jutro przystąpić do roboty.

Agent-readiness jako koncepcja nie jest kompletna, bo sam obszar jeszcze się kształtuje. Ale rama sześciofilarowa, którą tu zbudowaliśmy, powinna być stabilna wystarczająco, żeby myśleć nią o agentach przez najbliższe dwa-trzy lata. Kiedy poszczególne standardy dojrzeją, kiedy pojawią się nowe narzędzia, kiedy ekonomika ruchu agentowego ustabilizuje się — dokładamy szczegóły. Ale sześć pytań, na które trzeba mieć odpowiedź, nie zmieni się. Czy agent cię czyta? Czy cię rozumie? Czy masz kontrolę nad jego dostępem? Czy może coś zrobić? Czy wiesz, kim jest? I co z tego masz.Odpowiedzi na nie to cały agent-readiness.