Przez lata wystarczało myśleć o stronie jak o czymś, co trzeba dobrze opisać, zaindeksować i wypchnąć wysoko w wynikach. Ten model nie zniknął. Nadal ma sens. Ale przestał wystarczać.

Dziś strona nie jest już tylko znajdowana. Bywa też cytowana w odpowiedziach, streszczana przez systemy syntezy i odczytywana operacyjnie przez narzędzia, które próbują ustalić, co da się na niej zrobić. OpenAI oficjalnie rozróżnia dziś różne crawlery i user-agentów, w tym GPTBot, OAI-SearchBot i ChatGPT-User. Google wprost opisuje dane strukturalne jako sposób lepszego rozumienia treści strony i bytów opisanych na stronie. W3C od lat podkreśla, że nagłówki, etykiety i relacje informacji powinny być opisowe i programowo uchwytne.

To jest diagnoza z dzisiejszej perspektywy, nie gotowa teoria przyszłego webu. Ale jednego można być prawie pewnym: jeśli web stanie się naprawdę agentowy, nie oprze się na stronach efektownych, tylko na stronach poprawnie zbudowanych. Takich, które da się nie tylko wyświetlić, ale też odczytać jako strukturę, zrozumieć jako źródło i wykonać jako sekwencję możliwych działań. Już obecne dokumentacje dużych platform pokazują kierunek: coraz większe znaczenie mają semantyka, struktura i jednoznaczność działania.

To zmienia sens optymalizacji.

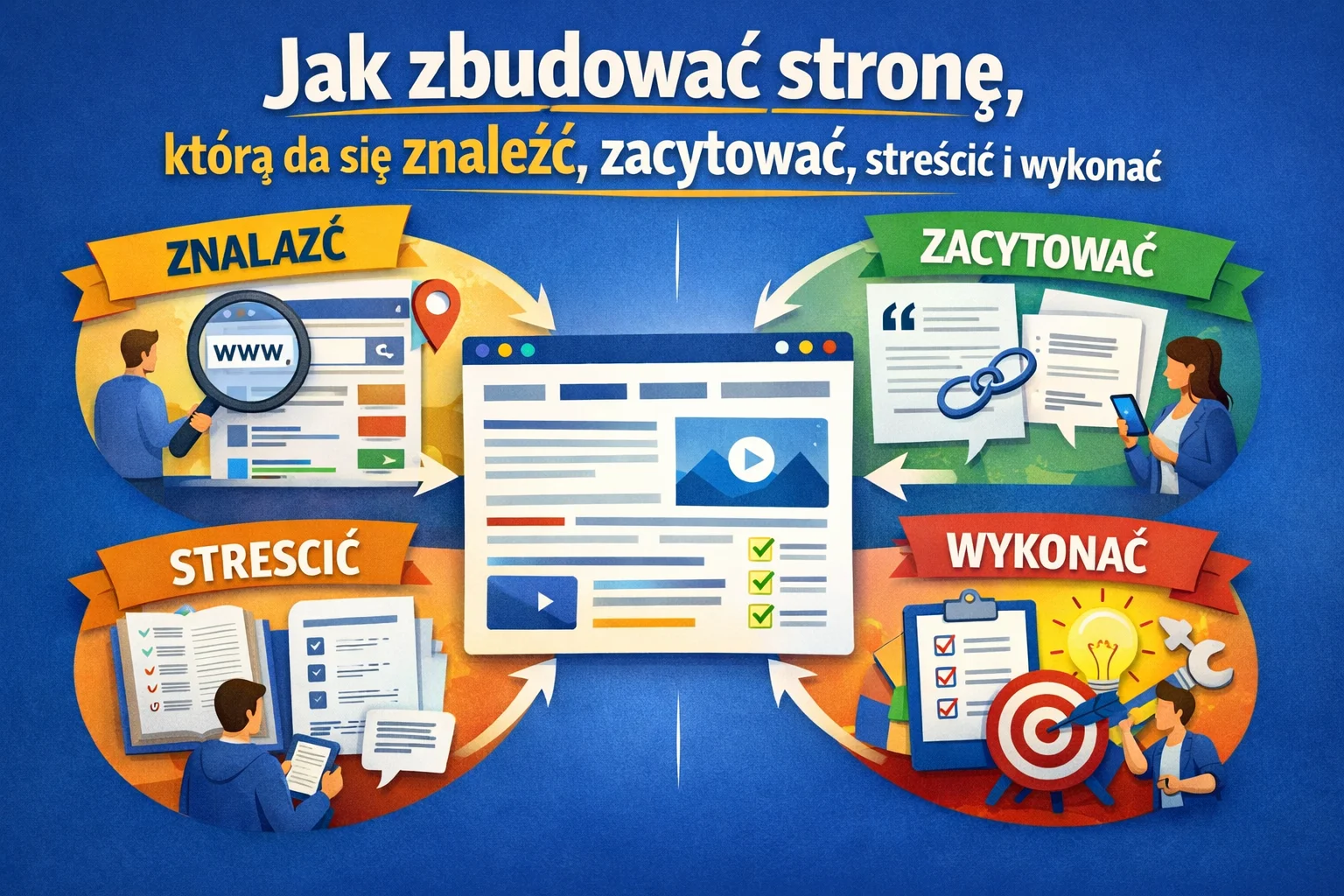

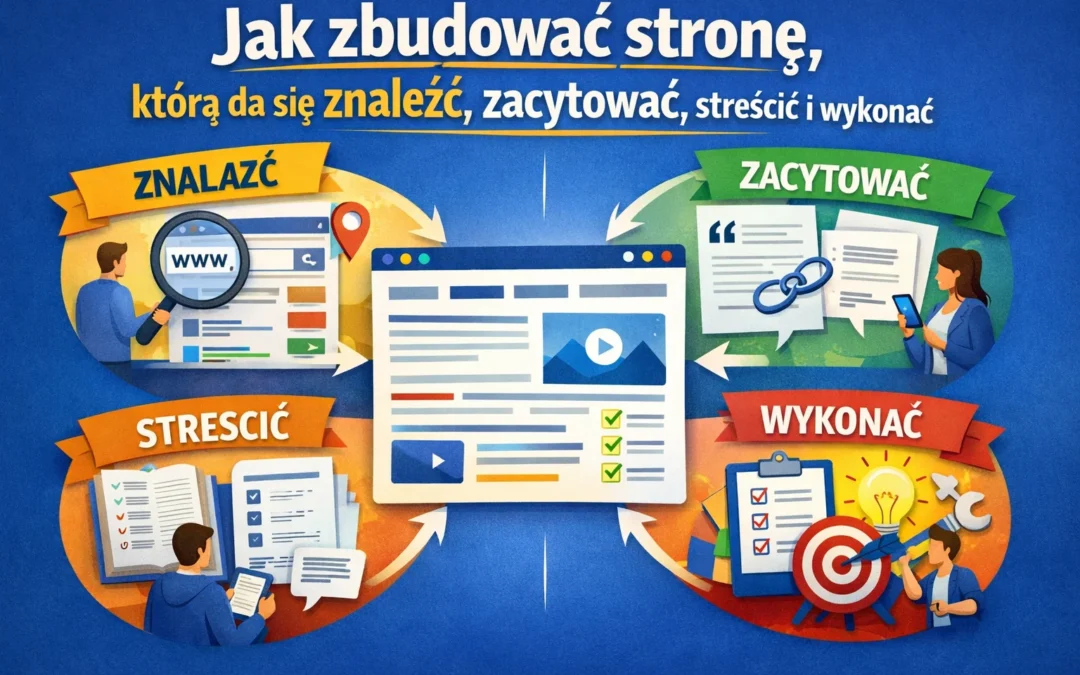

Nie wystarczy już zbudować strony, którą da się znaleźć. Trzeba zbudować taką, którą da się jeszcze poprawnie zacytować, uczciwie streścić i jednoznacznie wykonać.

To jest moim zdaniem nowy punkt ciężkości po SEO.

1. Strona jako obiekt do znalezienia

Pierwszy poziom wciąż pozostaje ten sam: strona musi dać się odkryć. Musi być zrozumiała tematycznie, czytelna dla systemów indeksujących i wystarczająco dobrze uporządkowana, by mogła wejść do obiegu. To nie jest przeszłość. To nadal fundament.

Ale właśnie: fundament.

Problem zaczyna się wtedy, gdy traktujemy ten fundament jak pełny opis rzeczywistości. Bo dziś obecność w indeksie nie oznacza jeszcze kontaktu z użytkownikiem. Między stroną a człowiekiem coraz częściej stoi dodatkowa warstwa: odpowiedź AI, wynik wzbogacony, syntetyczne podsumowanie, narzędzie porównawcze, agent wykonujący zadanie.

Dlatego „być znalezionym” to już za mało. To dopiero pierwszy warunek uczestnictwa.

2. Strona jako źródło do cytowania

Drugi poziom jest trudniejszy. Strona musi zawierać jednostki sensu, które da się wydobyć bez zniszczenia znaczenia.

To oznacza bardzo prostą rzecz: tekst powinien produkować zdania, które da się wyjąć i które nadal niosą myśl. Definicje. Rozróżnienia. Konkretnie sformułowane tezy. Fragmenty, które nie są tylko płynnym przejściem między akapitami, ale samodzielnymi nośnikami sensu.

W świecie odpowiedzi syntetycznych nie wygrywa wyłącznie treść długa ani wyłącznie treść krótka. Wygrywa treść, która ma dobrze zbudowane jednostki cytowalne.

To nie znaczy, że każdy akapit ma być sloganem. Chodzi raczej o to, by w każdej ważnej sekcji istniał przynajmniej jeden fragment, który da się przywołać, zacytować albo osadzić w odpowiedzi bez całkowitego rozpadnięcia się sensu.

Strona, której nie da się cytować, staje się trudniejsza do włączenia w nowy obieg widoczności.

3. Strona jako materiał do streszczenia

Trzeci poziom to kompresja.

Coraz więcej systemów nie konsumuje stron w całości. Zamiast tego próbują wydobyć główną myśl, skrócić ją, ułożyć w logiczny porządek i zwrócić użytkownikowi w formie odpowiedzi. To oznacza, że strona musi dać się streścić.

Ale tu pojawia się pułapka.

Dać się streścić nie znaczy: być całkowicie wymienną. Nie chodzi o to, by pisać treść gładką, bez tarcia i bez własnego charakteru, tylko dlatego, że łatwo ją skompresować. Taki tekst jest może wygodny dla systemu, ale zwykle nie zostawia po sobie śladu źródła.

Dobra strona powinna więc spełniać dwa warunki naraz: być podatna na streszczenie i jednocześnie zachowywać własny punkt widzenia. Po kompresji nadal powinno być wiadomo, nie tylko „co zostało powiedziane”, ale też „z jakiej perspektywy zostało to powiedziane”.

To właśnie tutaj zaczyna się prawdziwa różnica między treścią użyteczną a treścią wymienną.

4. Strona jako interfejs działania

Czwarty poziom jest dziś niedoceniany, a w praktyce może się okazać najważniejszy.

Nie każda strona służy tylko do czytania. Wiele stron służy do zrobienia czegoś: kupienia, zapisania się, pobrania, porównania, wysłania formularza, rozpoczęcia procesu, sprawdzenia oferty, przejścia do kolejnego kroku.

Dla człowieka ten porządek bywa intuicyjny, nawet jeśli strona jest zbudowana średnio. Dla systemu już niekoniecznie.

Jeśli strona ma być „wykonywalna”, jej logika działania musi być czytelna. Powinno być jasne:

czym ta strona jest,

dla kogo jest,

co można na niej zrobić,

jaki jest następny krok,

jakie informacje są potrzebne do wykonania akcji.

Tu właśnie semantyka przestaje być dodatkiem technicznym, a staje się częścią projektu doświadczenia. Google wprost pisze, że używa danych strukturalnych do lepszego rozumienia zawartości strony i elementów świata opisanych na stronie, a W3C wskazuje, że opisowe nagłówki, etykiety i relacje informacji pomagają zarówno w rozumieniu treści, jak i w nawigacji.

Jeśli web ma mieć warstwę agentową, to właśnie tutaj będzie się rozstrzygać jego realna użyteczność: nie na poziomie efektownej deklaracji, ale na poziomie tego, czy strona da się operacyjnie odczytać.

5. Struktura nie jest dodatkiem. Jest warunkiem odczytu

Przez długi czas można było traktować strukturę jako wykończenie treści. Najpierw „co chcemy powiedzieć”, później „jak to ułożymy”. Dziś ten porządek się odwraca.

Struktura staje się częścią samej treści.

Nagłówki nie są już tylko rytmem dla oka. Etykiety nie są tylko dodatkiem do formularzy. Hierarchia sekcji nie jest wyłącznie porządkiem wizualnym. To wszystko jest warstwą interpretacji. Dzięki niej można zrozumieć, gdzie zaczyna się temat, gdzie kończy argument, co jest definicją, co jest przykładem, co jest akcją, a co tylko komentarzem.

W standardach W3C widać to bardzo wyraźnie: nagłówki i etykiety powinny opisywać temat lub cel, a relacje informacji powinny być zachowane tak, by dało się je odczytać także poza czysto wizualnym układem strony.

To nie jest detal dla perfekcjonistów. To jest warunek czytelności w środowisku, w którym stronę czytają już nie tylko ludzie patrzący na ekran.

6. Dobra strona musi przechodzić cztery testy naraz

Z tej perspektywy dobra strona nie jest już tylko stroną „dobrze zoptymalizowaną”. Jest stroną, która przechodzi jednocześnie cztery testy.

Po pierwsze: da się ją znaleźć.

Po drugie: da się ją zacytować.

Po trzecie: da się ją streścić bez zniszczenia głównej myśli.

Po czwarte: da się ją wykonać jako logiczny układ możliwych działań.

Dopiero suma tych cech tworzy dziś coś, co można by nazwać nowoczesną czytelnością strony.

Nie chodzi więc już wyłącznie o to, czy tekst rankuje. Trzeba pytać szerzej:

czy da się z niego wydobyć sens,

czy da się go zweryfikować,

czy da się go skompresować,

czy po kompresji zostaje ślad źródła,

czy wiadomo, co można z nim zrobić.

To jest moim zdaniem ważniejsza zmiana niż kolejna aktualizacja jakiegokolwiek algorytmu.

7. Nowe pytanie po SEO

Być może najważniejsze jest dziś nie to, jakiej techniki użyć, tylko z jakim pytaniem siada się do projektowania strony.

Przez lata podstawowe pytanie brzmiało: czy to się pozycjonuje?

Dziś to nie wystarczy.

Lepiej pytać:

czy tę stronę da się odnaleźć,

czy da się ją poprawnie odczytać,

czy da się z niej wyjąć sensowny fragment,

czy da się ją streścić bez utraty autora,

czy da się na niej wykonać zadanie.

To pytania bardziej wymagające, ale też znacznie bliższe realnemu środowisku, w którym działa dziś web.

Bo problem nie brzmi już tylko: jak być wysoko.

Problem brzmi: jak zbudować stronę, która po przejściu przez pośrednika nadal zachowuje sens, źródło i możliwość działania.

Na koniec

Najłatwiej byłoby sprowadzić całą tę zmianę do prostego hasła: teraz trzeba pisać pod AI.

Ale to opis zbyt płytki.

Tak naprawdę nie chodzi o pisanie pod AI. Chodzi o projektowanie stron dla webu, w którym pośrednictwo stało się stałą warstwą środowiska. Niezależnie od tego, jak dokładnie rozwinie się agentic web, już dziś widać, że będzie premiował strony poprawnie zbudowane: semantyczne, czytelne, przewidywalne i jednoznaczne w działaniu. Oficjalne materiały OpenAI, Google i W3C wskazują właśnie w tę stronę: osobne role crawlerów i user-agentów, większe znaczenie zrozumiałej struktury oraz technik, które pozwalają systemom poprawnie interpretować zawartość strony.

Nie wygrywa już tylko strona, którą da się znaleźć.

Coraz częściej wygrywa ta, którą da się jeszcze zacytować, streścić i wykonać — i której nie da się po drodze całkiem odłączyć od źródła.